TypeDance: إنشاء شعارات طباعة دلالية من الصور من خلال التوليد المخصص

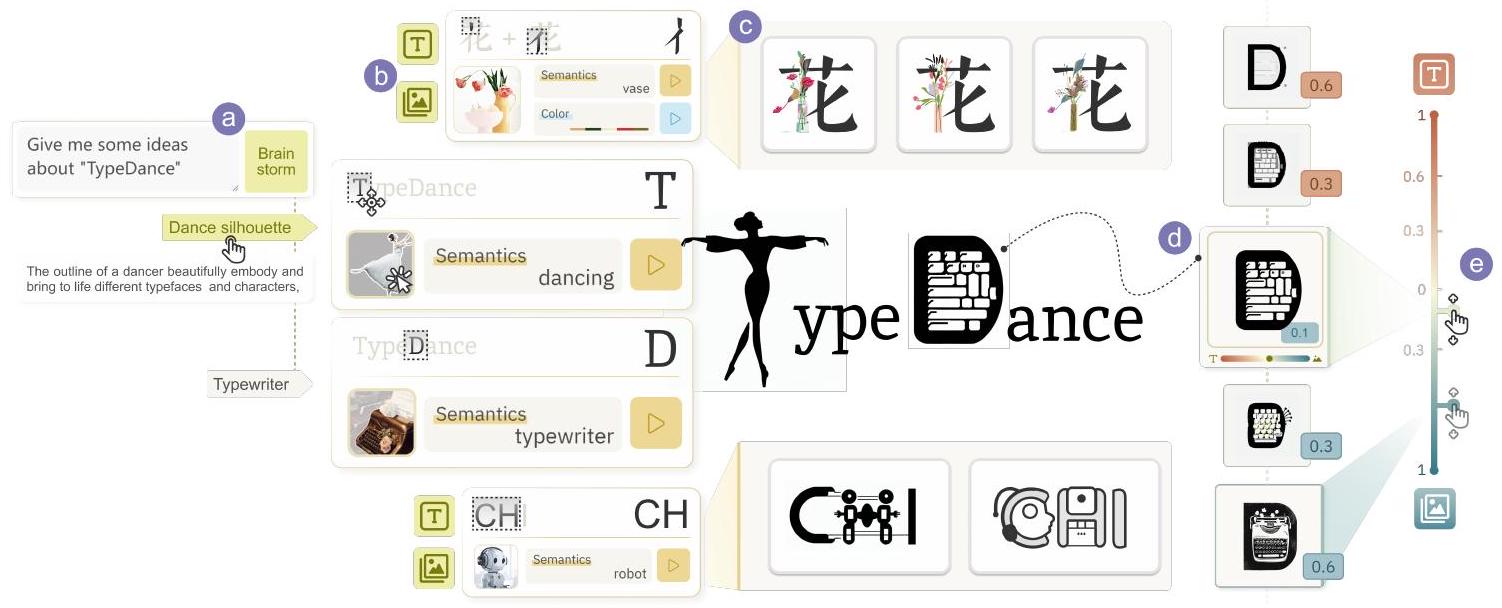

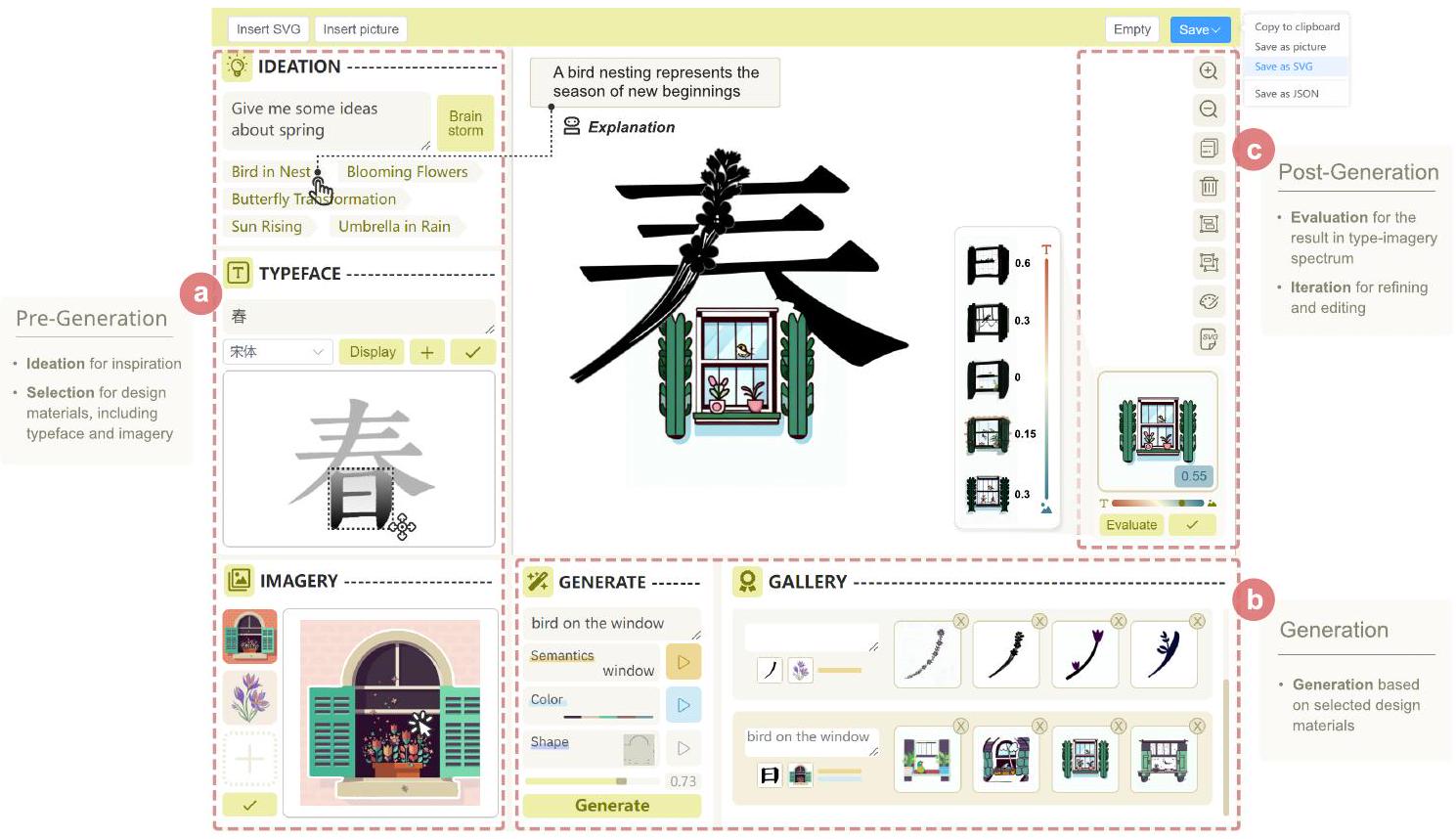

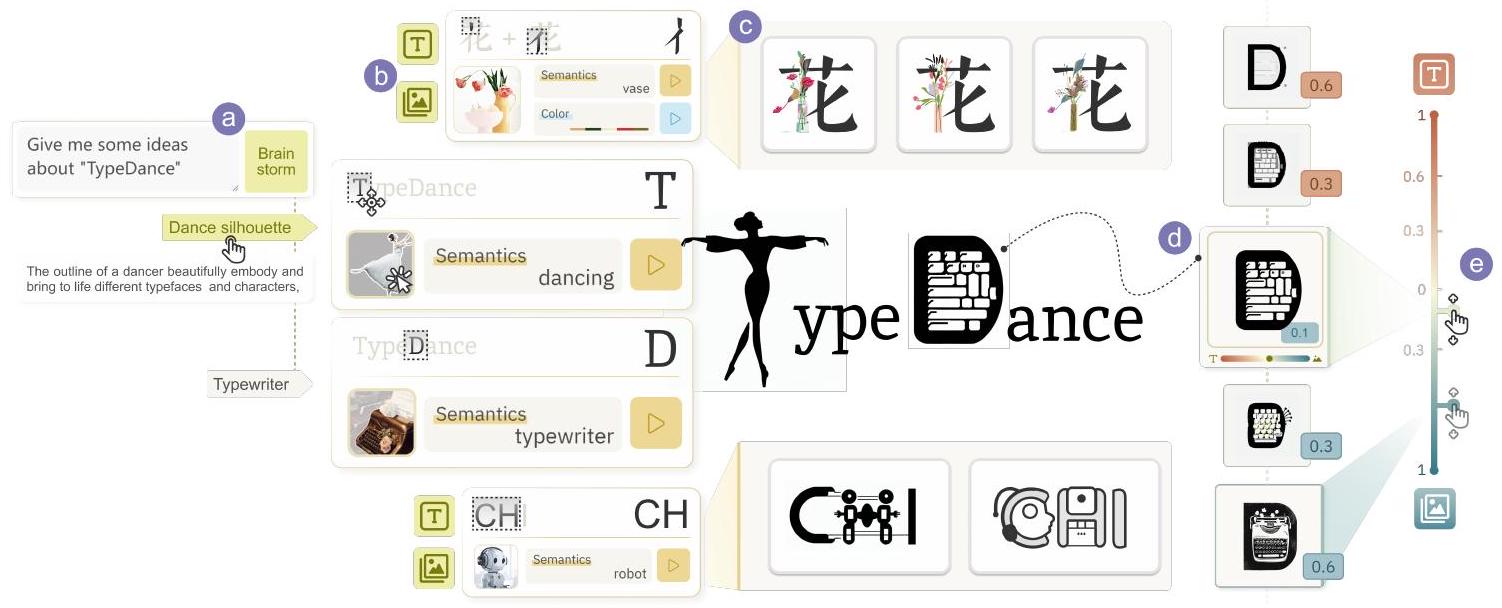

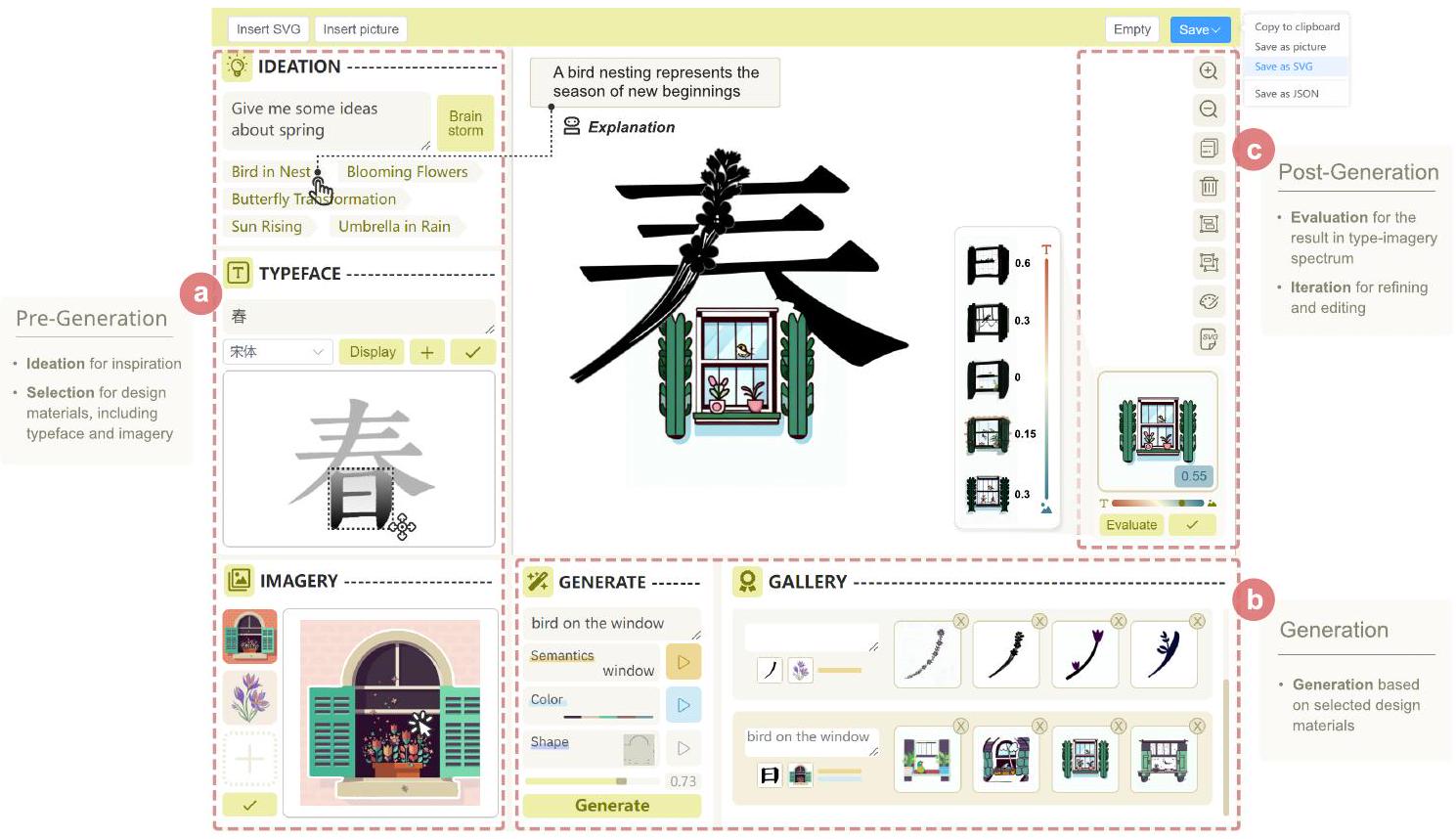

الشكل 1. TypeDance هو أداة تأليف لإنشاء شعارات طباعة دلالية بتصميم مرن وشخصي. من خلال تقطير مبادئ التصميم، فإنه يجسد سير العمل التصميمي ويمكّن المبدعين من (أ) التفكير مع وكيل ذكاء اصطناعي قابل للتفسير، (ب) اختيار نوع الخط بمستويات مختلفة من الدقة والصور من الصور، (ج) التوليد من خلال دمج نوع الخط المختار مع الصور المستهدفة، ثم يمكن للمبدع (د) تقييم و (هـ) تكرار موضع النتيجة الناتجة في طيف الخط والصورة.

تمزج الشعارات الطباعة الدلالية بشكل متناغم بين نوع الخط والصورة لتمثيل المفاهيم الدلالية مع الحفاظ على القابلية للقراءة. تعيق الطرق التقليدية التي تستخدم التركيب المكاني واستبدال الأشكال المتطلبات المتضاربة لتحقيق دمج مكاني سلس بين أنواع الخطوط غير المتشابهة هندسياً والدلالات. بينما جعلت التقدمات الأخيرة من توليد الطباعة الدلالية بواسطة الذكاء الاصطناعي ممكنًا، فإن الأساليب الشاملة تستبعد مشاركة المصممين وتغفل التصميم الشخصي. تقدم هذه الورقة TypeDance، أداة مدعومة بالذكاء الاصطناعي تدمج المبادئ التصميمية مع النموذج التوليدي لتصميم شعارات الطباعة الدلالية الشخصية. تستفيد من المبادئ التصميمية القابلة للجمع المستخرجة من نماذج الصور المرفوعة وتدعم رسم خرائط الخط والصورة بمستويات هيكلية مختلفة، مما يحقق تصاميم جمالية متنوعة مع تحكم مرن. بالإضافة إلى ذلك، نقوم بتجسيد سير عمل تصميم شامل في TypeDance، بما في ذلك التفكير، الاختيار، التوليد، التقييم، والتكرار. أكدت تقييم المستخدمين المكون من مهمتين، بما في ذلك التقليد والإبداع، على قابلية استخدام TypeDance في التصميم عبر سيناريوهات استخدام مختلفة.

مفاهيم CCS:

- منهجيات الحوسبة

الذكاء الاصطناعي.

كلمات وعبارات إضافية: الطباعة الدلالية، النموذج التوليدي، التصميم الشخصي

تنسيق مرجع ACM:

شيشي شياو، ليانغ وي وانغ، شياوجوان ما، ووي زينغ. 2018. TypeDance: إنشاء شعارات طباعة دلالية من الصورة من خلال التوليد الشخصي. في . ACM، نيويورك، نيويورك، الولايات المتحدة الأمريكية، 24 صفحة.https://doi.org/XXXXXXX.XXXXXXX

1 المقدمة

الطباعة الدلالية هي فن دمج نوع الخط والصورة، حيث يتم تصور نوع الخط كتمثيل بصري دلالي مع وضوح عالٍ وقابلية قراءة [21،23،47]. أحد التطبيقات الملحوظة هو الشعار الطباعة الدلالية، الذي يرمز إلى هوية فريدة بطريقة مختصرة ولكن معلوماتية. بسبب تعبيره وقابليته للتذكر [7]، تم استخدام الشعار الطباعة الدلالية على نطاق واسع كتوقيعات بصرية للأفراد [28]، وشعارات تجارية ذات قيمة تجارية [15، 20]، ورموز للأحداث المهمة وترويج المدن [3، 43].

ومع ذلك، فإن إنشاء شعار طباعة دلالية يمثل تحديًا كبيرًا، يتطلب دمجًا سلسًا بين نوع الخط والصورة مع الحفاظ على قابلية القراءة. غالبًا ما يعتمد المصممون ذوو الخبرة على برامج احترافية مثل Adobe Illustrator لضبط مخطط نوع الخط يدويًا لدمج صور معينة، وهو عملية تستغرق وقتًا طويلاً وعرضة للأخطاء. غالبًا ما يجربون أنماطًا مختلفة من الخطوط أو الحروف وأنواعًا مختلفة من الصور للعثور على تمثيل بصري جذاب وقابل للتذكر، مما يزيد من طول العملية. يتطلب ذلك تفكيرًا إبداعيًا، ومهارات عملية، والقدرة على الاستمرار من خلال التجربة والخطأ المستمر. بالإضافة إلى ذلك، تتطلب الهوية الفريدة للشعار مستوى عالٍ من التخصيص والشخصنة في عملية التصميم.

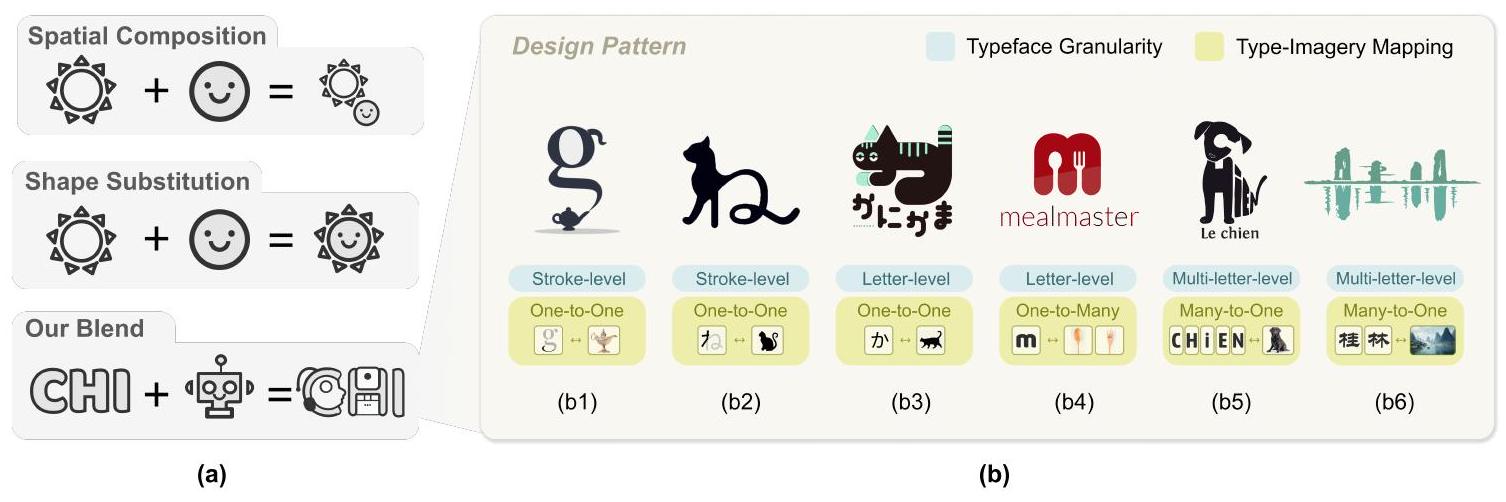

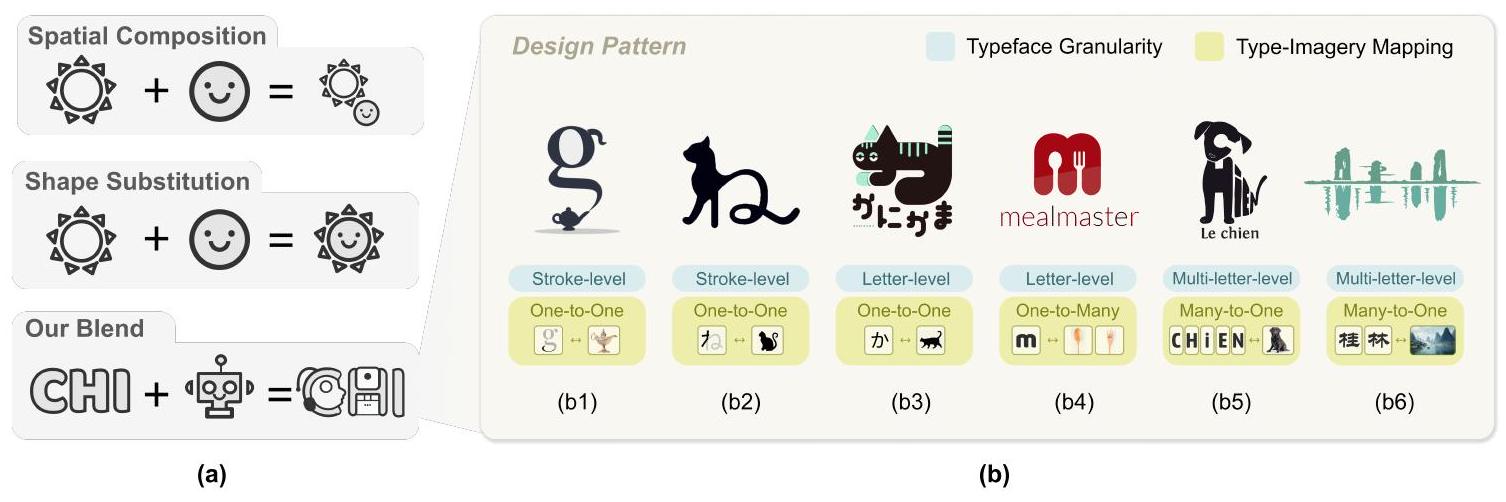

هناك تحديان رئيسيان في الأبحاث ذات الصلة: تقنية الدمج والتأليف الواعي للنوايا. تستفيد أدوات التأليف الحالية من تقنيات دمج متنوعة لإنشاء أنواع أخرى من التصاميم، مثل الرموز الرسومية. كما هو موضح في الشكل 3، تهدف إحدى التقنيات النموذجية إلى دمج المواد الموجودة مكانيًا [13، 64]. تستخدم تقنية أخرى استبدال الأشكال لتحقيق دمج مكاني أكثر، لكنها تعتمد بشكل كبير على تشابه الأشكال بين الكائنات التي يتم دمجها [8، 9]. على الرغم من أن بعض تقنيات التصميم الحسابية تدعم دمج الصور في أنواع الخطوط، إلا أنها مقيدة بالقدرة على تغيير أجزاء معينة من أنواع الخطوط [4، 23، 48]. جعلت التقدمات في نماذج التوليد من النص إلى الصورة [42،63] من الممكن توليد الطباعة الدلالية تلقائيًا، لكنها تطرح تحديًا آخر حول التأليف الواعي للنوايا. نظرًا للعديد من التفاصيل مثل العرض البصري المحدد (مثل الدلالات، اللون، والشكل) في تصميم الشعار، قد لا تكون النصوص التوجيهية قادرة على تمثيل هذه النوايا.

تهدف هذه الدراسة إلى الحصول على رؤى حول مساحة التصميم وسير العمل المعنيين في إنشاء شعارات الطباعة الدلالية، ثم تجسيد هذه المبادئ التصميمية لإنشاء أداة مدعومة بالذكاء الاصطناعي تسهل التوليد الشخصي. من خلال تحليل مجموعة مختارة، تم تحديد مساحة تصميم منهجية، تركز على دقة نوع الخط (أي، مستوى السكتة الدماغية، الحرف، ومستوى الحروف المتعددة) ورسم خرائط الخط والصورة (أي، رسم خرائط واحد إلى واحد، واحد إلى العديد، والعديد إلى واحد). بالإضافة إلى ذلك، تم إجراء مقابلات مع ثلاثة خبراء لجمع رؤى حول التحديات والاهتمامات المتعلقة بالتعاون مع الذكاء الاصطناعي في عملية التصميم. أبرزت النتائج الفرصة لتبسيط عملية الدمج المرهقة وتحديد مادة واضحة وصريحة للتواصل الفعال لنوايا التصميم إلى النماذج التوليدية.

نقترح TypeDance، أداة تأليف تمكّن كل من المبتدئين والمصممين من تقنية دمج قوية لإنشاء شعارات طباعة دلالية من الصور المخصصة من قبل المستخدم. مستلهمين من “صورة واحدة تساوي ألف كلمة” [17،44] و”كل ما تراه يمكن أن يكون مادة تصميم” [14،62]، نسمح للمبدعين بالتعبير عن

نوايا التصميم الخاصة بهم من خلال تسليط الضوء على التمثيل البصري في صورهم الخاصة. في الوقت نفسه، يتم استخراج مصادر إلهام تصميم متعددة من مراجع الصور لتخصيص التصميم. بالإضافة إلى ذلك، نقدم تقنية دمج جديدة تعتمد على نماذج الانتشار التي تدعم دمج الصور مع نوع الخط على جميع مستويات الدقة. لضمان قابلية قراءة كل من نوع الخط والصورة، نستفيد من نموذج رؤية-لغة لمساعدة المبدعين في تحديد موضع الناتج الناتج ضمن طيف الخط والصورة. كما نُمكّنهم من تعديل وتحسين الناتج، مثل جعله يشبه نوع الخط ”

(1) دراسة تشكيلية تحدد أنماط التصميم القابلة للتعميم وسير العمل القابل للمحاكاة.

(2) إدخال واعٍ للنوايا يعتمد على صورة مخصصة من قبل المستخدم تتجاوز النصوص التوجيهية الغامضة، مما يوفر وصفًا بصريًا مفصلًا لتصميم الشعار المطلوب للذكاء الاصطناعي التوليدي.

(3) تقنية دمج تدمج بسلاسة الصور مع جميع مستويات دقة نوع الخط.

(4) أداة تأليف تدمج سير عمل شامل، مما يمكّن المبدعين من التفكير، الاختيار، التوليد، التقييم، والتكرار في تصاميمهم.

نوايا التصميم الخاصة بهم من خلال تسليط الضوء على التمثيل البصري في صورهم الخاصة. في الوقت نفسه، يتم استخراج مصادر إلهام تصميم متعددة من مراجع الصور لتخصيص التصميم. بالإضافة إلى ذلك، نقدم تقنية دمج جديدة تعتمد على نماذج الانتشار التي تدعم دمج الصور مع نوع الخط على جميع مستويات الدقة. لضمان قابلية قراءة كل من نوع الخط والصورة، نستفيد من نموذج رؤية-لغة لمساعدة المبدعين في تحديد موضع الناتج الناتج ضمن طيف الخط والصورة. كما نُمكّنهم من تعديل وتحسين الناتج، مثل جعله يشبه نوع الخط ”

(1) دراسة تشكيلية تحدد أنماط التصميم القابلة للتعميم وسير العمل القابل للمحاكاة.

(2) إدخال واعٍ للنوايا يعتمد على صورة مخصصة من قبل المستخدم تتجاوز النصوص التوجيهية الغامضة، مما يوفر وصفًا بصريًا مفصلًا لتصميم الشعار المطلوب للذكاء الاصطناعي التوليدي.

(3) تقنية دمج تدمج بسلاسة الصور مع جميع مستويات دقة نوع الخط.

(4) أداة تأليف تدمج سير عمل شامل، مما يمكّن المبدعين من التفكير، الاختيار، التوليد، التقييم، والتكرار في تصاميمهم.

2 الأعمال ذات الصلة

2.1 تصميم شعار الطباعة الدلالية

شعارات الطباعة الدلالية هي تكامل متناغم بين نوع الخط والصورة، حيث يتم توضيح الصورة بصريًا بواسطة نوع الخط [23، 43، 48]. بالمقارنة مع العلامة النصية البسيطة [50، 52] والشعار التصويري [22، 30]، يسمح الشعار الطباعة الدلالية بنهج أكثر تماسكًا لترميز كل من المحتوى النصي والرسومي وتعزيز الارتباط بينهما. لقد أدت القدرة على تجسيد الرمزية الغنية والتعبيرية إلى زيادة اعتماد شعارات الطباعة الدلالية عبر سيناريوهات مختلفة، مثل الترويج الثقافي [3]، والعلامات التجارية التجارية [15]، والهوية الشخصية [28]. لقد استكشفت الأبحاث الواسعة كيف يمكن تصميم أنواع الخطوط لتعزيز المعنى الدلالي على مستويات مختلفة من الدقة. تقسم بعض الدراسات نوع الخط إلى سلسلة من الضربات الهيكلية مع تقسيم موجه من قبل المستخدم [38] وتقسيم تلقائي [4]، ثم تطبق التزيين الهيكلي على كل ضربة ونقطة تقاطع بشكل منفصل. في المقابل، حولت الدراسات الحديثة [23، 48، 59] تركيزها من تزيين مستوى الضربة إلى تزيين الحروف الفردية باستخدام قوالب محددة مسبقًا. على سبيل المثال، استبدل تندولكار وآخرون [48] الحروف بأيقونات كليب آرت ذات صلة بالصورة وتشبه بصريًا الحرف المقابل. نهج آخر، كما أظهر شيو وآخرون [55]، يتضمن ضغط الحروف المتعددة وترتيبها في شكل دلالي محدد مسبقًا. لقد تم تعزيز هذا النهج بشكل أكبر من قبل زو وآخرون [66]، الذين اقترحوا إطار عمل تلقائي يدعم وضع وتعبئة وتشويه الكاليغرامات المضغوطة.

بينما بحثت الأبحاث السابقة بشكل موسع في الشعار الطباعة الدلالية عبر درجات تصميم نوع الخط المختلفة، لا تزال هناك مشكلتان رئيسيتان: 1) تم بناء هذه النماذج لأنواع الخطوط بدقة محددة، مما يحد من قابليتها للتطبيق، و2) القليل معروف عن العلاقة بين نوع الخط والصورة. عادةً ما تستخدم هذه الأعمال نهجًا بسيطًا حيث يتم إقران نوع خط واحد بصورة محددة واحدة. لاستكشاف مساحة التصميم، نجمع مجموعة بيانات من العالم الحقيقي، ونحلل دقة نوع الخط وعلاقة نوع الخط بالصورة، ونطبق هذه المبادئ التصميمية في TypeDance. ثم نقترح إطار عمل موحد يعتمد على نموذج الانتشار لدعم المزج المرن بين الصور وأنواع الخطوط بمستويات دقة مختلفة.

2.2 نموذج توليدي للتصميم الحسابي

لقد حظي التصميم الحسابي باهتمام كبير في مجال التقنيات التوليدية. مؤخرًا، كانت هناك تقدمات في محاذاة المعنى الدلالي بين أزواج الصور والنصوص، مما يجعل اللغة الطبيعية أداة قيمة تسد الفجوة بين البشر والإبداع [29، 39]. استغلت العديد من الدراسات مثل هذه الاتساق الدلالي لاسترجاع الصور ذات الصلة من مجموعة البيانات باستخدام بيانات اللغة الطبيعية، والتي يمكن استخدامها كمواد تصميم لتوليد تصاميم جديدة [12، 64]. بينما اعتمدت الدراسات السابقة على الاسترجاع من مجموعة بيانات محدودة وقوالب محددة مسبقًا، اقترحت الأبحاث الحديثة نماذج انتشار النص إلى الصورة [40، 47] التي تتجاوز نماذج GAN السائدة [18] ونماذج الانحدار الذاتي [41]. ومع ذلك، يعتمد هذا التوليد الموجه بالنص بشكل كبير على المطالبات المصممة جيدًا، مما يؤدي إلى نتائج غير مستقرة تفتقر إلى التحكم من قبل المستخدم. لمعالجة هذه المشكلة وتعزيز تخصيص المستخدم، قدمت التقدمات الحديثة شروطًا قائمة على الصور لتحقيق التلاعبات القابلة للتحكم، بما في ذلك خريطة العمق [42] وخريطة الحواف [63]. تدعم بعض النماذج التوليدية التي تركز على تزيين الخطوط فقط توليد مستوى الحروف [23] وتتطلب جمع الصور التي تحتوي على الصورة المحددة لضبط النموذج [47].

بينما أظهرت الأعمال السابقة قدرة توليدية مذهلة في إنشاء هياكل معقدة ودلالات ذات معنى، لا يزال ضمان قابلية قراءة كل من نوع الخط والصورة يمثل تحديًا صعبًا. على وجه الخصوص، تفتقر شروط النص إلى قيود كافية لالتقاط جميع نوايا المستخدم، بينما تكون شروط الصورة صارمة للغاية ولا يمكن أن تستوعب إدراج معلومات إضافية. لمواجهة هذا التحدي، اقترح مو وآخرون [34] نهجًا يجمع بين شروط متعددة لتحسين القابلية للتحكم. بالمثل، يقوم Vistylist [45] بفك تشابك مساحة التصميم، مما يمكّن من التوليد مع عوامل التصميم المقصودة من قبل المستخدم. يبني TypeDance على هذه الجهود البحثية السابقة من خلال توفير عدة مبادئ تصميم تشير إلى خصائص شعارات الطباعة الدلالية. تعمل هذه المبادئ التصميمية المستخرجة من الصور المقدمة من المستخدم كإرشادات للمستخدمين لاختيارها ودمجها في تصاميمهم. مع دعم لكل من شروط النص والصورة، يمكّن TypeDance المستخدمين من التحكم المرن، مما يتيح نتائج تصميم شخصية ومميزة.

2.3 أداة تأليف التصميم الجرافيكي

لقد طورت أعمال كبيرة أدوات تأليف لتسهيل التصميم الجرافيكي، والتي يمكن تقسيمها بشكل عام إلى فئتين رئيسيتين: أدوات الإبداع وأدوات الإنشاء. في مجال الإبداع، اقترحت عدة دراسات بحثية [24، 26، 56] واجهات تهدف إلى إلهام الأفكار وتسهيل استكشاف مواد التصميم. على سبيل المثال، استخدم MetaMap [24] هيكلًا يشبه خريطة ذهنية تشمل ثلاثة أبعاد تصميم لتحفيز المستخدمين وتشجيعهم على توليد مجموعة واسعة من الأفكار الفريدة والمتنوعة. فيما يتعلق بعملية الإنشاء، كما حدد شياو وآخرون [54]، تتبع الأعمال السائدة خط أنابيب من مرحلتين، يتضمن استرجاع أمثلة وتكييفها كمواد تصميم [62] ومرجع نقل الأسلوب [45]. مؤخرًا، سعى الباحثون إلى دمج الأساليب لإنشاء تصميم جديد بناءً على مواد التصميم الموجودة. خلال العملية، يتم اعتماد تجميع أيقونات ذات صلة دلاليًا بشكل مكاني لتوليد تصميم مركب بطريقة مبتكرة من قبل بعض الباحثين [13، 64]. بالمثل، أظهر زانغ وآخرون [61] أن تجميع عناصر الصورة المتماسكة يمكن أن ينشئ نوع خط زينة بتغطية مفاهيم واسعة. من ناحية أخرى، استكشفت تشيلتون وآخرون [8، 9] المزيد من إمكانيات الدمج من خلال استبدال الأشكال المماثلة. على سبيل المثال، أظهروا أن “شعار ستاربكس” يمكن أن يحل محل موضع “الشمس” حيث أن كلاهما له شكل دائري.

ومع ذلك، تواجه تقنيات التركيب المكاني واستبدال الأشكال تحديات عند التعامل مع تعقيد شعارات الطباعة الدلالية، حيث يحتاج نوع الخط والصورة إلى الاندماج مكانيًا ككل على الرغم من غياب تشابه الشكل. في هذا العمل، يستخدم Typedance نماذج الانتشار لدمج تفاصيل الصورة بينما

يحافظ على التمثيل البارز لنوع الخط، مما يمكّن من مزج أكثر طبيعية. بالإضافة إلى ذلك، يدمج Typedance كل من وظائف الإبداع والإنشاء. لضمان قابلية قراءة كل من نوع الخط والصورة في شعارات الطباعة الدلالية، تم دمج عنصر تقييم إضافي، مما يعزز مصداقية عملية التصميم.

يحافظ على التمثيل البارز لنوع الخط، مما يمكّن من مزج أكثر طبيعية. بالإضافة إلى ذلك، يدمج Typedance كل من وظائف الإبداع والإنشاء. لضمان قابلية قراءة كل من نوع الخط والصورة في شعارات الطباعة الدلالية، تم دمج عنصر تقييم إضافي، مما يعزز مصداقية عملية التصميم.

3 دراسة تشكيلية

لتطبيق مبادئ التصميم الحقيقية في TypeDance، استخرجنا سير عمل تصميم قابل للمحاكاة من مقابلات شبه منظمة وأنماط تصميم قابلة للتعميم من تحليل مجموعة البيانات.

المشاركون. أجرينا مقابلات شبه منظمة مع ثلاثة خبراء: أستاذ تصميم يقود فرق تصميم الشعارات للمؤتمرات الدولية وهويات المدن (E1)، مصمم علامة تجارية لديه أكثر من 11 عامًا من الخبرة في تصميم شعارات الشركات والشركات الناشئة (E2)، ومصمم شعارات حصل على عدة جوائز تصميم مشهورة (E3). جميع الخبراء الثلاثة لديهم خبرة واسعة في تصميم الطباعة الدلالية.

الإجراء. بدأت كل مقابلة فردية، التي استمرت من ساعة إلى ساعة ونصف، بعرض عمل الشخص المقابل من وسائل التواصل الاجتماعي. ثم تعمقنا في تفسيرهم وشرحهم التفصيلي لعملية التصميم. أخيرًا، طرحنا أسئلة حول الخطوات الرئيسية في إنشاء شعار طباعة دلالية، وأصعب خطوة، والتوقعات والاهتمامات بشأن النماذج التوليدية.

المشاركون. أجرينا مقابلات شبه منظمة مع ثلاثة خبراء: أستاذ تصميم يقود فرق تصميم الشعارات للمؤتمرات الدولية وهويات المدن (E1)، مصمم علامة تجارية لديه أكثر من 11 عامًا من الخبرة في تصميم شعارات الشركات والشركات الناشئة (E2)، ومصمم شعارات حصل على عدة جوائز تصميم مشهورة (E3). جميع الخبراء الثلاثة لديهم خبرة واسعة في تصميم الطباعة الدلالية.

الإجراء. بدأت كل مقابلة فردية، التي استمرت من ساعة إلى ساعة ونصف، بعرض عمل الشخص المقابل من وسائل التواصل الاجتماعي. ثم تعمقنا في تفسيرهم وشرحهم التفصيلي لعملية التصميم. أخيرًا، طرحنا أسئلة حول الخطوات الرئيسية في إنشاء شعار طباعة دلالية، وأصعب خطوة، والتوقعات والاهتمامات بشأن النماذج التوليدية.

3.1 سير العمل العامة والتحديات

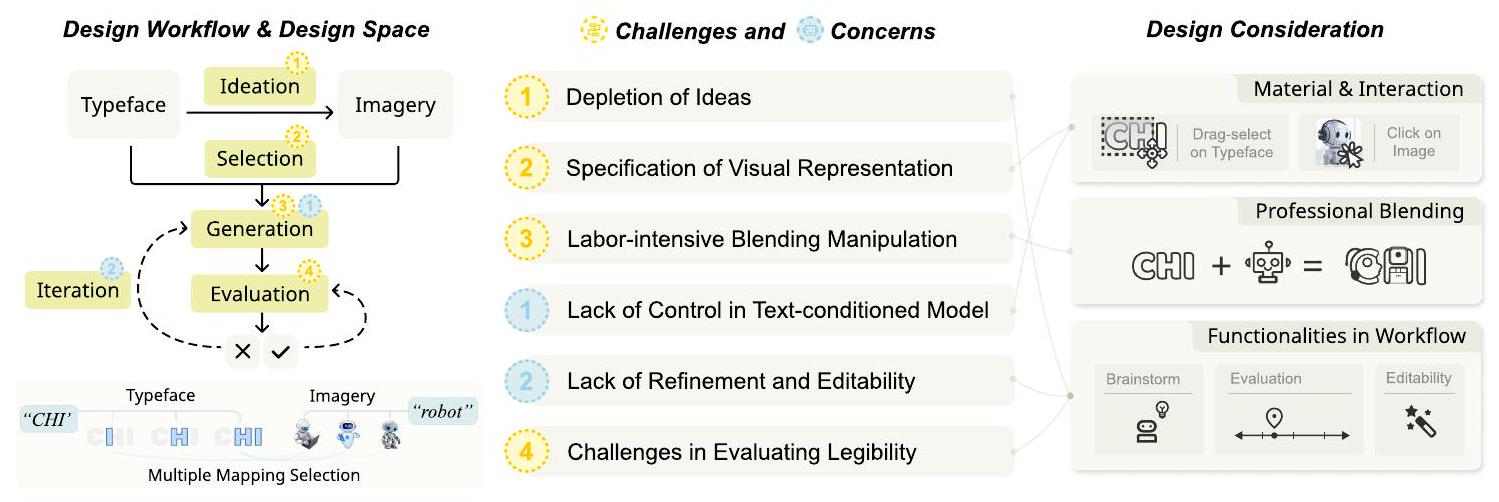

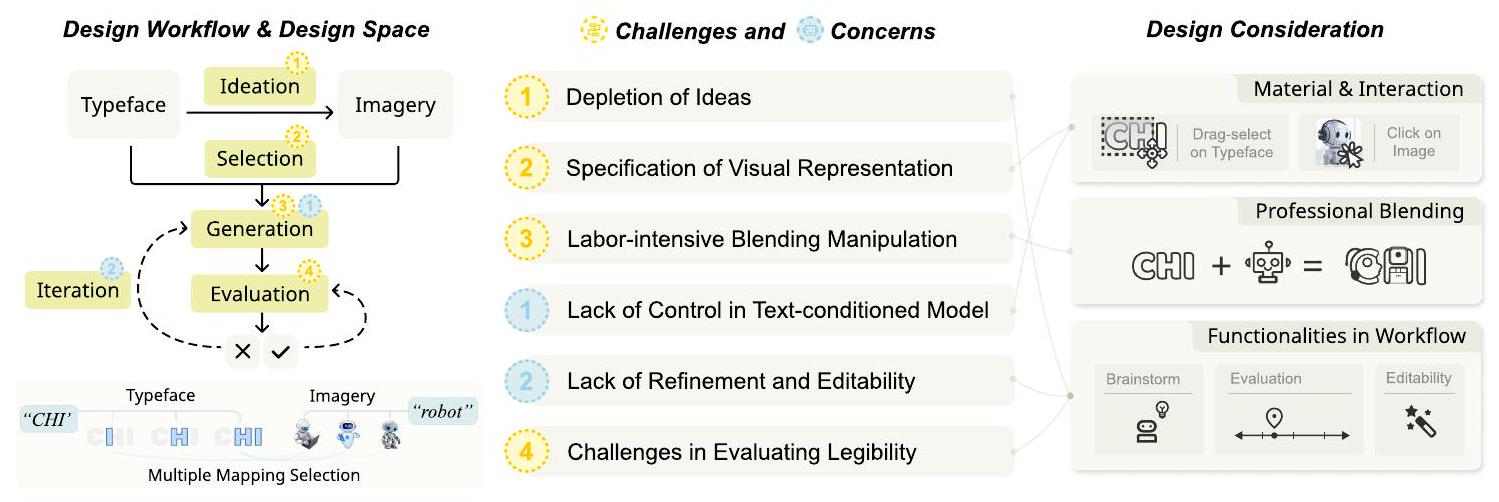

3.1.1 سير العمل العام في التصميم. تصميم الطباعة الدلالية هو عملية إبداعية تتضمن توليد أفكار مبتكرة وتنفيذها. كما هو موضح في الشكل 2، يتكون سير العمل العام عادةً من خمس خطوات.

- توليد الأفكار. في البداية، غالبًا ما يُعطى المصممون نصًا ثابتًا، مثل اسم العلامة التجارية. استنادًا إلى سيناريوهات الاستخدام، يحتاجون إلى ابتكار أفكار جديدة تتعلق بالصور المحتملة.

- الاختيار. بمجرد أن يؤكد المصممون فكرة التصميم، يقومون بإعداد مواد التصميم مع جانبين حاسمين: 1) جزء من هيكل الخط و 2) التمثيل البصري المحدد للصور. تتطور اختيار الخط من خلال محاولات متعددة مع درجات مختلفة، مثل ضربة واحدة أو الخط بالكامل. ذكر جميع الخبراء أنهم حصلوا على الإلهام للتمثيل البصري من الصور، سواء التي قدمها العملاء، أو التي تم جمعها من مجتمعات مشاركة التصميم، أو من معرض حياتهم الخاص. تعتبر الصور أيضًا مصدرًا لإلهام آخر. كما أشار E1، “عادةً ما أكتشف إلهامًا جديدًا في الصور، مثل لوحة الألوان.”

- الجيل. يبدأ المصممون بتبسيط التمثيل البصري إلى شكل أساسي يتوافق مع هيكل الخط في الرسم. ثم يقومون بتعديل مخطط الخط باستخدام برامج احترافية مثل أدوبي إليستريتور، مما يدمجها بسلاسة مع الصور المختارة.

- التقييم. عند الانتهاء من التصميم، سيقوم المصممون بتقييم وضوح كل من الخط والصور المدمجة في عملهم. وغالبًا ما يعتمد ذلك على التحقق الخارجي من أفراد آخرين غير المصممين أنفسهم.

- التكرار. يتم إجراء التكرار طوال عملية التصميم. يقوم المصممون بإجراء تجارب متعددة وتحسينات في كل خطوة للوصول إلى النتائج المحتملة. يستمر التحسين حتى يتم تحقيق تصميم نهائي.

3.1.2 التحديات في سير العمل.

(1) استنفاد الأفكار خلال جلسات العصف الذهني. يعتبر الخبراء على نطاق واسع أن ولادة الإلهام الجيد هي مزيج من الخيال والصدفة. يؤكد E2 على أهمية التعمق في القصة وراء العلامة التجارية ثم دمجها في تصميم الشعار. يتضمن ذلك جمع المعرفة الخلفية واكتشاف الصور التي تتناغم مع الإدراك البشري. تعتبر الخطط المتنوعة للبدائل ضرورية للتكرار.

الشكل 2. تم توضيح سير العمل العام لتصميم الشعار الطبوغرافي الدلالي من خلال مقابلة الخبراء، مع تحديد التحديات الرئيسية في سير العمل واهتمامات الذكاء الاصطناعي التوليدي في المراحل المقابلة. استنادًا إلى سير العمل والتحديات والاهتمامات، تم تعزيز اعتبارات التصميم لـ Typedance.

(2) توضيح التمثيل البصري المحدد للصور. يستكشف المصممون غالبًا أجزاء متنوعة من نوع الخط أثناء تجربتهم مع خيارات الصور المختلفة لتحقيق النتائج الأكثر مثالية وجاذبية بصريًا. ومع ذلك، يمكن تصوير صورة واحدة بطرق بصرية متنوعة، كما هو موضح من خلال الروبوتات المتنوعة في الشكل 2، مما يشكل تحديًا في تحديد واحدة معينة. بالإضافة إلى ذلك، يمكن أن تعقد توافق الصورة مع نوع الخط عملية الاختيار.

3) التلاعب الممل والمرهق في دمج نوع الخط والصور. يتطلب تصميم شعار من مسودة تصور وتنفيذ احترافي لدمج صور وأنواع خط مختلفة بشكل كبير. كما ذكرت E3، “أحيانًا يكون من الصعب عندما يصر عميلتي على وجود كل من الحرف ‘M’ وقط يقف من الصورة التي أعطتني إياها – من الصعب العثور على أوجه التشابه في أشكالها.” بالنسبة للتنفيذ، على الرغم من الاعتماد على برامج احترافية مثل CorelDRAW وAdobe Illustrator، تظل عملية الدمج يدوية، مما يستهلك قدرًا كبيرًا من الوقت والجهد.

4) التحديات في تقييم القابلية للقراءة. يجب أن لا يسبب الشعار الطباعي الدلالي الناجح ارتباكًا للجمهور بشأن نوع الخط أو معناه. ومع ذلك، غالبًا ما يعتمد تقييم القابلية للقراءة على الحكم الذاتي للمصممين بدلاً من أن يكون مستندًا إلى إدراك الجمهور العام. وهذا يشكل تحديًا في تحقيق تقييم عادل.

3) التلاعب الممل والمرهق في دمج نوع الخط والصور. يتطلب تصميم شعار من مسودة تصور وتنفيذ احترافي لدمج صور وأنواع خط مختلفة بشكل كبير. كما ذكرت E3، “أحيانًا يكون من الصعب عندما يصر عميلتي على وجود كل من الحرف ‘M’ وقط يقف من الصورة التي أعطتني إياها – من الصعب العثور على أوجه التشابه في أشكالها.” بالنسبة للتنفيذ، على الرغم من الاعتماد على برامج احترافية مثل CorelDRAW وAdobe Illustrator، تظل عملية الدمج يدوية، مما يستهلك قدرًا كبيرًا من الوقت والجهد.

4) التحديات في تقييم القابلية للقراءة. يجب أن لا يسبب الشعار الطباعي الدلالي الناجح ارتباكًا للجمهور بشأن نوع الخط أو معناه. ومع ذلك، غالبًا ما يعتمد تقييم القابلية للقراءة على الحكم الذاتي للمصممين بدلاً من أن يكون مستندًا إلى إدراك الجمهور العام. وهذا يشكل تحديًا في تحقيق تقييم عادل.

3.2 المخاوف المتعلقة بمشاركة النموذج التوليدي

مع ظهور النماذج التوليدية مثل ميدجورني، بدأ العديد من المصممين في تبني الذكاء الاصطناعي كمساعد في التصميم. فيما يلي اثنان من المخاوف الرئيسية بشأن تدخل الذكاء الاصطناعي في عملية تصميمهم.

(1) نقص القدرة على التحكم في النموذج التوليدي المعتمد على النص. الطريقة الأكثر استخدامًا للتحكم في النماذج التوليدية هي من خلال العبارات النصية. على الرغم من أن هناك أدوات متنوعة يمكن أن تساعد في تصميم العبارات، مثل PromptBase

(1) نقص القدرة على التحكم في النموذج التوليدي المعتمد على النص. الطريقة الأكثر استخدامًا للتحكم في النماذج التوليدية هي من خلال العبارات النصية. على الرغم من أن هناك أدوات متنوعة يمكن أن تساعد في تصميم العبارات، مثل PromptBase

الشكل 3. (أ) مقارنة تقنية المزج بين الأعمال السابقة وTypeDance. (ب) بعض أمثلة الشعارات الطبوغرافية الدلالية من المجموعة، كل منها مُعَلَّم بنمط التصميم المقابل، بما في ذلك دقة نوع الخط ورسم الصور بالنوع.

- نقص في التهذيب وقابلية التعديل للنتائج الناتجة. يبدو أن نقص قابلية التعديل في النتائج هو مشكلة شائعة في النماذج المولدة. بينما قد يكون المستخدمون راضين بشكل عام عن النتيجة الكلية، قد تكون هناك حالات لا تلبي فيها بعض التفاصيل توقعاتهم (مثل، عدم إعجابهم بالألوان، أو وجود أشياء زائدة). إحدى الطرق لمعالجة ذلك هي إعادة توليد الصورة بالكامل، مما يؤدي إلى فقدان التصميم الحالي.

3.3 مساحة التصميم للطباعة الدلالية

لتحديد أنماط التصميم التي تشكل الشعارات الطبوغرافية الدلالية بشكل أكبر، نقوم بجمع وتحليل مجموعة من 427 مثالًا من العالم الحقيقي.

3.3.1 دقة نوع الخط. بينما تمتلك اللغات المختلفة رموزها الفريدة، إلا أنها تتوافق مع دقة هيكلية مشتركة. تتضمن هذه التسلسل الهرمي، المرتب من المحلي إلى العالمي، الخط، الحرف، ومتعدد الحروف، على التوالي.

3.3.1 دقة نوع الخط. بينما تمتلك اللغات المختلفة رموزها الفريدة، إلا أنها تتوافق مع دقة هيكلية مشتركة. تتضمن هذه التسلسل الهرمي، المرتب من المحلي إلى العالمي، الخط، الحرف، ومتعدد الحروف، على التوالي.

- مستوى الضربة. غالبًا ما يستخدم تحليل الضربات، حيث يتم ربط ضربة واحدة أو مجموعة من الضربات بالصور (123/427 مثال). كما هو موضح في الشكل 3 (b1)، يتماشى فوهة إبريق الشاي مع المنحنى الأصلي في الحرف “

“، مما يعزز التعبير الدلالي مع الحفاظ على سلامة نوع الخط. كأصغر وحدة في نوع الخط، يمكن تنفيذ مزج مستوى السكتة عدة مرات داخل نوع الخط لإثراء التمثيل البصري. - مستوى الحرف. تُستخدم الحروف الفردية بشكل شائع في مجموعتنا المجمعة (189/427 مثال). بدلاً من إجراء دمج على مستوى الحرف لكل حرف على حدة، تميل بعض الأمثلة إلى التركيز على حروف تمثيلية جزئيًا داخل الكلمة، لا سيما الحرف الأول في الشكل 3 (b6). لتأكيد الصورة، يستخدمون تقنيات مثل التغيير في الحجم، والإطالة، والدوران على الحروف.

- مستوى متعدد الحروف. دمج الصور مع حروف متعددة أو كلمات كاملة هو دمج مستوى متعدد الحروف (115/427 مثال). يعتبر الخط وحدة متماسكة وينظم الحروف مكانيًا في موضع مناسب. وفقًا للشكل 3 (b5)، يتم إعادة ترتيب الحروف وتشويهها لإنشاء الشكل الظاهر المعروف لكلب.

3.3.2 رسم الخرائط بين النوع والصورة. نلاحظ ارتباطًا معقدًا بين نوع الخط والصورة. تبسط الأعمال السابقة هذا الارتباط من خلال اعتماد استراتيجية رسم خرائط واحدة، حيث يتم ربط حرف واحد بصورة معينة. لتقريب TypeDance من ممارسة التصميم لشعار الطباعة الدلالية، نقوم بتشفير المجموعة يدويًا وتحديد ثلاثة أنماط رسم خرائط نموذجية: واحد إلى واحد، واحد إلى متعدد، متعدد إلى واحد. مع فهم شامل لكيفية تفاعل نوع الخط مع الصورة، يمكننا تجسيد مبادئ التصميم بشكل أفضل لتعزيز عملية الإبداع. - تطابق واحد إلى واحد. يتوافق شعار واحد مع صورة واحدة تُلاحظ عادةً في المجموعة.

أمثلة). إنها تحافظ على هياكل الخط باستخدام ضربات أو حروف جزئية لتمثيل نفس الصورة. على سبيل المثال، في الشكل 3 (ب1)، تتضمن الحرف “g” صورة لصنبور إبريق الشاي. بالإضافة إلى ذلك، لاحظنا أن الشعارات التي تحتوي على تطابق واحد لواحد غالبًا ما تستخدم صورًا متكررة بأسلوب متسق ضمن نوع خط معين. - توزيع واحد إلى متعدد. الشعار الطبوغرافي الدلالي في هذا الجزء سيقوم بتوزيع صور متعددة في نوع الخط المستخدم في التصميم (14/427 مثال). يدعم هذا النوع من التوزيع تغطية غنية للصور ضمن مساحة مضغوطة، حيث تشترك المفاهيم الدلالية عادة في نفس الموضوع. الشكل 3 (b4) يدمج كل من الملعقة والشوكة في حرف

، مما يبرز موضوع الوجبة. - الخرائط المتعددة إلى واحدة. يتضمن جانب آخر دمج عدة حروف في نوع خط واحد في صورة واحدة (119/427 مثال)، وعادة ما يتم تحقيق ذلك من خلال دمج كلمات كاملة لنقل تمثيل بصري معقد للمعنى، انظر الشكل 3 (b3، b4). يمكن تتبع هذا النهج الإبداعي إلى جوزيبي أركيمبولدو، الذي دمج ببراعة عناصر وأشكال مختلفة لإنشاء بورتريهات وأشكال متماسكة [32]. تعزز الخرائط المتعددة إلى واحدة الوحدة العامة وتعمق التعبير عن المعنى الدلالي.

3.3.3 الملخص. من خلال تحليل النصوص، نكشف عن تباين في نوع الخطوط وأنماط مختلفة من تصوير الحروف. يجمع مزيج هذه الأنماط التصميمية فرصة لنقل تمثيلات بصرية غنية. تلتزم كل من الرموز الكتابية واللغات الأبجدية بهذه الأنماط ولكنها تظهر تفضيلات مميزة. الهيكل المعقد للخطوط في الرموز الكتابية وأصولها التصويرية المتأصلة يؤديان إلى تركيبات تصويرية أكثر تعقيدًا. على سبيل المثال، مقارنةً بالكلمة الفرنسية في الشكل 3 (b5)، تحقق الكلمات الصينية في الشكل 3 (b6) تمازجًا مع اللوحات التقليدية للمناظر الطبيعية دون إعادة ترتيب الخطوط مكانيًا.

بالإضافة إلى ذلك، نلاحظ الفروق في تصميم الشعارات في العالم الحقيقي مقارنة بالتعريف الرسمي للطباعة الدلالية. في تصميم الشعارات في العالم الحقيقي، لا يتم تطبيق المزج بشكل موحد على جميع الخطوط. بدلاً من ذلك، يتم التركيز على الحروف في الموضع الأول أو تلك المرتبطة دلالياً بالصورة.

4 اعتبارات التصميم

تكشف المقابلة مع الخبراء أن تخصيص شعار طباعة دلالي يعتمد على دمج أنواع خط معينة (مثل، بمستويات دقة مختلفة) وصور (مثل، تمثيل بصري ملموس)، والتي تم تحديدها بشكل أكبر من خلال تحليل النصوص. تبرز التحديات في سير عمل المستخدم والقلق بشأن الذكاء الاصطناعي التوليدي أهمية استخدام الصور المتاحة بسهولة لتحقيق تخصيص فعال، مما يلغي الحاجة إلى مطالبات نصية معقدة قد لا تعكس نوايا المستخدم بالكامل. موجهة

وفقًا لمبدأ تصميم شنييدرمان [46] المتمثل في “التصميم مع عتبات منخفضة، وأسقف عالية، وجدران واسعة”، هدفنا هو تطوير أداة تمكّن المبتدئين من الإبداع باستخدام مواد وتفاعلات سهلة الوصول (D1)، وتقوم بأتمتة معالجة الخلطات المعقدة للمحترفين (D2)، وتدمج الوظائف الأساسية لعملية تصميم سلسة (D3). يتم توضيح خارطة الطريق التي نستمد منها اعتبارات التصميم في الشكل 2. أدناه، نقدم مجموعة من اعتبارات التصميم:

وفقًا لمبدأ تصميم شنييدرمان [46] المتمثل في “التصميم مع عتبات منخفضة، وأسقف عالية، وجدران واسعة”، هدفنا هو تطوير أداة تمكّن المبتدئين من الإبداع باستخدام مواد وتفاعلات سهلة الوصول (D1)، وتقوم بأتمتة معالجة الخلطات المعقدة للمحترفين (D2)، وتدمج الوظائف الأساسية لعملية تصميم سلسة (D3). يتم توضيح خارطة الطريق التي نستمد منها اعتبارات التصميم في الشكل 2. أدناه، نقدم مجموعة من اعتبارات التصميم:

D1. تصميم المواد والتفاعل المدرك للنوايا. نهدف إلى دعم اختيار المواد المرنة، مما يسمح بالتبديل السهل بين أنواع الخطوط بمستويات دقة مختلفة واختيار الصور من تمثيلات بصرية محددة في صورة مخصصة من قبل المستخدم.

D2. تسهيل عملية توليد المحترفين. نهدف إلى اقتراح نهج خلط تلقائي يدعم الخطوط على جميع مستويات الدقة، مما يضمن تصاميم متناغمة ومتنوعة.

D3. توفير الوظائف اللازمة لدعم سير العمل الشامل. في مرحلة ما قبل التوليد، سنقوم بإدراج وحدة لتوليد الأفكار للعصف الذهني. في مرحلة ما بعد التوليد، ستتم إضافة وحدة التقييم والتكرار لتحديد وتحرير وتنقيح النتيجة المولدة ضمن طيف الصور النوعية.

D2. تسهيل عملية توليد المحترفين. نهدف إلى اقتراح نهج خلط تلقائي يدعم الخطوط على جميع مستويات الدقة، مما يضمن تصاميم متناغمة ومتنوعة.

D3. توفير الوظائف اللازمة لدعم سير العمل الشامل. في مرحلة ما قبل التوليد، سنقوم بإدراج وحدة لتوليد الأفكار للعصف الذهني. في مرحلة ما بعد التوليد، ستتم إضافة وحدة التقييم والتكرار لتحديد وتحرير وتنقيح النتيجة المولدة ضمن طيف الصور النوعية.

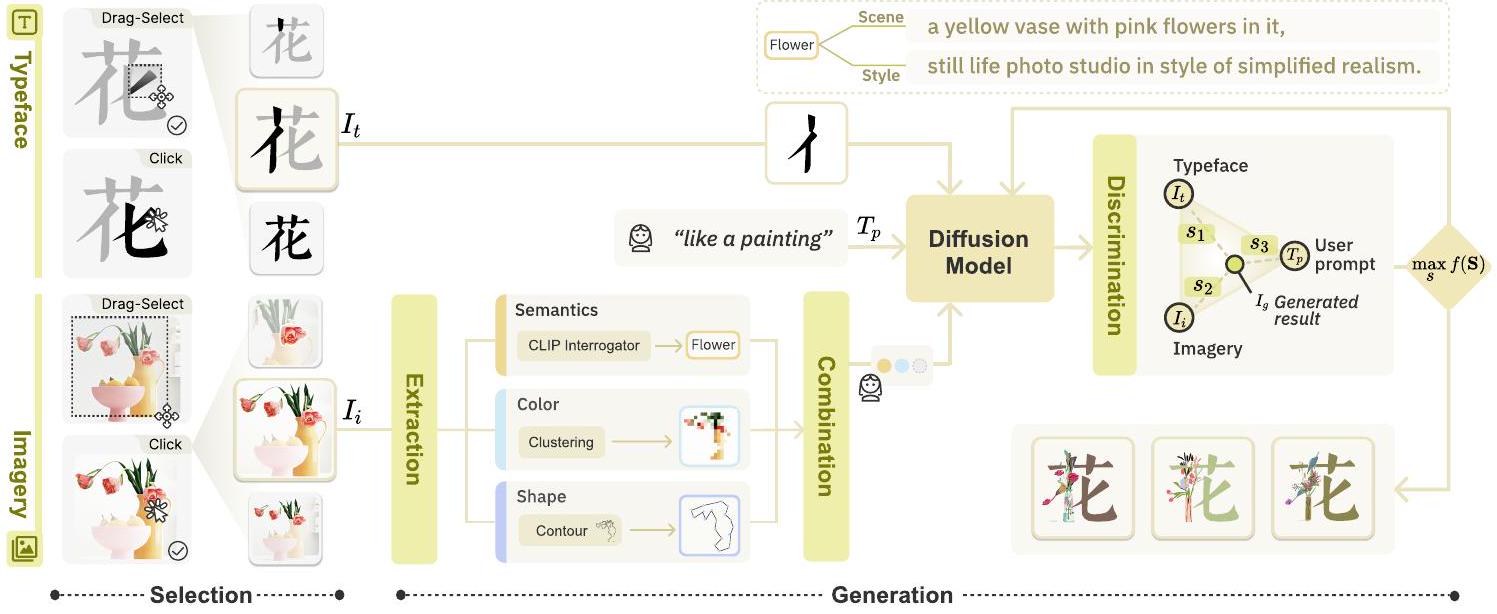

5 تايب دانس

استنادًا إلى المبررات التصميمية المحددة والفرصة المميزة لمعالجة التحديات والاهتمامات في سير العمل التصميمي، قمنا بتطوير TypeDance، وهو نظام تأليف يسهل التوليد الشخصي لشعارات الطباعة الدلالية. يتكون TypeDance من خمسة مكونات أساسية، تتوافق بشكل وثيق مع مراحل ما قبل التوليد، والتوليد، وما بعد التوليد. في مرحلة ما قبل التوليد، يتواصل مكون الإبداع مع المستخدم لجمع الصور المفهومة (D1). يتيح مكون الاختيار للمستخدم اختيار مواد تصميم محددة، بما في ذلك نوع الخط بمستويات مختلفة من التفاصيل والصور ذات التمثيلات البصرية المحددة (D2). يمزج مكون التوليد هذه المواد التصميمية، مستخدمًا سلسلة من المبادئ التصميمية القابلة للتجميع (D3). بعد التوليد، يمكّن مكون التقييم المستخدم من تقييم موقع النتيجة الحالية في طيف النوع-الصورة (D4). يمكّن مكون التكرار المستخدم من تحسين تصميمه من خلال ضبط طيف النوع-الصورة وتحرير كل عنصر فردي (D5).

5.1 توليد الأفكار

بفضل القدرات المذهلة لفهم اللغة والتفكير التي تتمتع بها نماذج اللغة الكبيرة، يمكننا الآن التعاون مع عقل مطلع من خلال النصوص. تستفيد TypeDance من Instruct GPT-3 (davinci-002) [36] مع تحفيز سلسلة الأفكار [53] لتوليد صور ذات صلة بناءً على النصوص المقدمة. لتعزيز فهم المستخدم، تتضمن استراتيجية التحفيز شرطًا لمرافقة الصور بشرح يتعلق بالتصميم البصري. وهذا يضمن أن تكون الإجابات المقدمة أكثر قابلية للتفسير ومعلوماتية. على سبيل المثال، عندما يقدم المستخدم الكلمة الرئيسية “هاواي”، تولد TypeDance صورًا ملموسة مثل “قميص ألوها”، “راقص الهولا”، و”شجرة النخيل”. بالإضافة إلى هذه الكلمات التصويرية، تقدم TypeDance أيضًا شروحات مثل “ترمز إلى الثقافة النابضة بالحياة وشكل الرقص التقليدي في هاواي” لراقص الهولا. من خلال إجراء هذا التغيير البسيط، تقدم TypeDance شروحات قابلة للتفسير وتوفر للمستخدمين معرفة إضافية لتعزيز فهمهم.

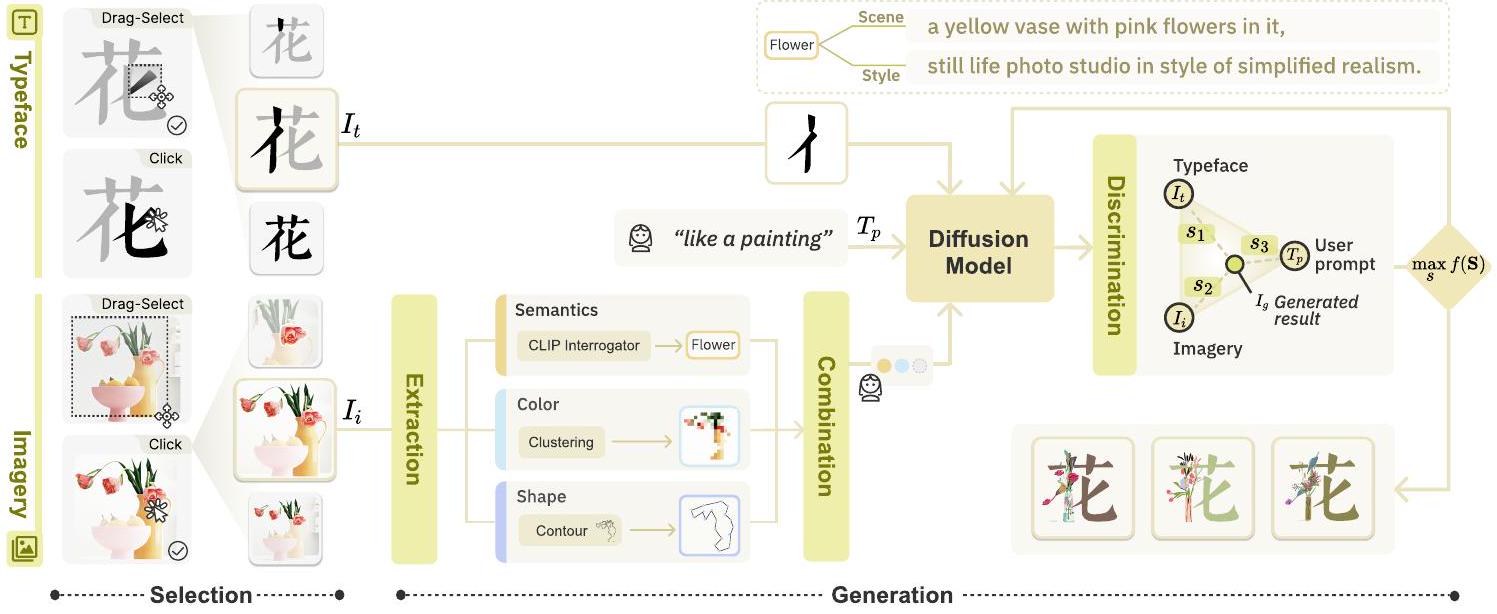

5.2 الاختيار

تهدف الاختيارات إلى إعداد مواد التصميم المدمجة في الجيل التالي. وهي تشمل عنصرين أساسيين: اختيار نوع الخط

الشكل 4. مكون الاختيار والتوليد في سير عمل TypeDance. يقدم مكون الاختيار نوعين من التفاعل لتمكين المبدعين من اختيار الخط بشكل مرن.

المحفزات البصرية كمدخل، بما في ذلك الصندوق والنقطة. كما هو موضح في الشكل 4، فإن الخصائص المختلفة المتأصلة في الخطوط والصور تؤدي إلى تفاعلات متنوعة تهدف إلى التوافق مع المبادئ التصميمية.

اختيار الخط. بالنظر إلى النص، يسمح TypeDance للمبدعين باختيار الخطوط

اختيار الصور. فيما يتعلق باختيار الصور، نستخدم التقسيم الدلالي لاستخراج التمثيل البصري الذي يحتاجه المبدعون من خلفية مزدحمة. ومع ذلك، على عكس اختيار الخط، فإن طبيعة اختيار الصور أكثر ملاءمة للنقر بدلاً من السحب والاختيار. كما هو موضح في الشكل 4، يمكن أن يشمل السحب والاختيار عن غير قصد أشياء أخرى قد لا يحتاجها المبدع أثناء اختيار الشيء المرغوب. لمعالجة هذه المشكلة، قمنا بتنفيذ حل حيث يمكن للمبدعين النقر على الأشياء الفردية بشكل منفصل، مما يقلل من مشكلة تغطية الأشياء غير المقصودة. بالمثل، يدعم TypeDance أيضًا الاختيار المركب، مما يسمح للمبدعين باختيار عدة أشياء داخل الصورة.

اختيار الخط. بالنظر إلى النص، يسمح TypeDance للمبدعين باختيار الخطوط

اختيار الصور. فيما يتعلق باختيار الصور، نستخدم التقسيم الدلالي لاستخراج التمثيل البصري الذي يحتاجه المبدعون من خلفية مزدحمة. ومع ذلك، على عكس اختيار الخط، فإن طبيعة اختيار الصور أكثر ملاءمة للنقر بدلاً من السحب والاختيار. كما هو موضح في الشكل 4، يمكن أن يشمل السحب والاختيار عن غير قصد أشياء أخرى قد لا يحتاجها المبدع أثناء اختيار الشيء المرغوب. لمعالجة هذه المشكلة، قمنا بتنفيذ حل حيث يمكن للمبدعين النقر على الأشياء الفردية بشكل منفصل، مما يقلل من مشكلة تغطية الأشياء غير المقصودة. بالمثل، يدعم TypeDance أيضًا الاختيار المركب، مما يسمح للمبدعين باختيار عدة أشياء داخل الصورة.

5.3 التوليد

5.3.1 توليد المدخلات. يصف هذا القسم المدخلات الثلاث المطلوبة لعملية التوليد. المدخل الأول هو الخط المختار

الدلالات. المحفز النصي هو وسيلة سهلة وبديهية للمبدعين لتوجيه الذكاء الاصطناعي، والذي يقدم أيضًا وسيلة لدمج الصور في عملية التوليد. ومع ذلك، من الصعب وصف كمية كبيرة من المعلومات ضمن قيود طول المحفز المحدود. يحل TypeDance هذه المشكلة من خلال استخراج وصف الصورة المختارة تلقائيًا. يتضمن وصف الصورة المختارة عملية عكس نص تشمل أبعاد دلالية ملموسة متعددة. واحدة من الدلالات البارزة هي الفهم البصري العام لمشهد. على سبيل المثال، في الشكل 4، يكون وصف المشهد هو “مزهرية صفراء مع زهور وردية.” نحن نلتقط هذه المعلومات البصرية الصريحة (الشيء، التخطيط، إلخ) باستخدام BLIP [29]، وهو نموذج رؤية-لغة يتفوق في مهام وصف الصور. علاوة على ذلك، يمكن أن يؤثر أسلوب الصورة، خاصة عندما يتعلق الأمر بالرسوم التوضيحية أو اللوحات، بشكل كبير على تمثيلها ويكون مصدر إلهام مشترك للمبدعين. أسلوب الحالة في الشكل 4 هو “صورة طبيعية في أسلوب الواقعية المبسطة.” يتم اشتقاق مثل هذا الأسلوب المحدد من استرجاع أوصاف ذات صلة ذات تشابه عالٍ في قاعدة بيانات المحفزات الضخمة. لذلك، تشمل الدلالات الكاملة للصورة المشهد والأسلوب. لتعزيز قابلية توسيع الواجهة، نستخرج الكلمات الرئيسية من الدلالات التفصيلية. لا يزال بإمكان المبدعين الوصول إلى النسخة الكاملة من خلال التحويم فوق الكلمات الرئيسية.

اللون. يستخدم TypeDance تجميع kNN [16] لاستخراج خمسة ألوان أساسية من الصورة المختارة. ثم يتم تطبيق هذه المواصفات اللونية في عملية التوليد التالية. من أجل الحفاظ على العلاقة الدلالية بين الألوان، يتم تحويل الألوان المستخرجة إلى لوحة ثنائية الأبعاد تشمل معلومات مكانية. يضمن ذلك أن الناتج المولد يحافظ على تركيبة لونية ذات معنى ومتسقة.

الشكل. يمكن أن يأخذ شكل الخط تشوهًا جماليًا لدمج صور غنية، كما هو موضح في دراستنا التكوينية. لتحقيق ذلك، استخدمنا أولاً كشف الحواف للتعرف على محيط الصورة المختارة. ثم، نقوم بأخذ 20 نقطة متساوية المسافة على طول المحيط. تُستخدم هذه النقاط لتشويه مخطط الخط بشكل تكراري، باستخدام إحداثيات باري سنترية عامة [33]. يحدث التشويه في الفضاء المتجهي، مما يؤدي إلى شكل معدّل يصور صورًا خشنة ويسهل التوليد الموجه.

اللون. يستخدم TypeDance تجميع kNN [16] لاستخراج خمسة ألوان أساسية من الصورة المختارة. ثم يتم تطبيق هذه المواصفات اللونية في عملية التوليد التالية. من أجل الحفاظ على العلاقة الدلالية بين الألوان، يتم تحويل الألوان المستخرجة إلى لوحة ثنائية الأبعاد تشمل معلومات مكانية. يضمن ذلك أن الناتج المولد يحافظ على تركيبة لونية ذات معنى ومتسقة.

الشكل. يمكن أن يأخذ شكل الخط تشوهًا جماليًا لدمج صور غنية، كما هو موضح في دراستنا التكوينية. لتحقيق ذلك، استخدمنا أولاً كشف الحواف للتعرف على محيط الصورة المختارة. ثم، نقوم بأخذ 20 نقطة متساوية المسافة على طول المحيط. تُستخدم هذه النقاط لتشويه مخطط الخط بشكل تكراري، باستخدام إحداثيات باري سنترية عامة [33]. يحدث التشويه في الفضاء المتجهي، مما يؤدي إلى شكل معدّل يصور صورًا خشنة ويسهل التوليد الموجه.

تُطبق هذه العوامل التصميمية بشكل مستقل خلال عملية التوليد. يتمتع المبدعون بالمرونة لدمج هذه العوامل وفقًا لاحتياجاتهم المحددة، مما يسمح بإنشاء تصميمات متنوعة وشخصية.

5.3.2 تمييز المخرجات. لضمان توافق النتيجة المولدة مع نية المبدعين، يستخدم TypeDance استراتيجية تقوم بتصفية النتائج الجيدة بناءً على ثلاث درجات. كما هو موضح في الشكل 4، نهدف إلى أن تحقق النتيجة المولدة

5.3.2 تمييز المخرجات. لضمان توافق النتيجة المولدة مع نية المبدعين، يستخدم TypeDance استراتيجية تقوم بتصفية النتائج الجيدة بناءً على ثلاث درجات. كما هو موضح في الشكل 4، نهدف إلى أن تحقق النتيجة المولدة

حيث S هو مجموعة الدرجات لجميع النتائج المولدة، و

5.4 التقييم

بمجرد توليد التصميم، فإن تقييم توافق التصميم مع مبادئ التصميم البصرية المعترف بها أمر بالغ الأهمية لإكماله [9، 37]. تتطلب الشعارات الطباعة الدلالية توازنًا بين قابلية قراءة الخط وتعبيرية الصورة، مما يقدم تناقضًا صعبًا. غالبًا ما يعتمد المصممون على تعليقات المشاركين للتحقق من تصميماتهم. يقدم TypeDance تقييمًا فوريًا مدفوعًا بالبيانات قبل جمع ردود فعل المشاركين.

لمساعدة المستخدمين في تحديد موقع عملهم الحالي على طيف النوع-الدلالي، يستخدم TypeDance نموذج CLIP المدرب مسبقًا [39] الذي يوفر حكمًا موضوعيًا مدعومًا بالبيانات. من خلال تقطير المعرفة من مجموعة بيانات ضخمة تضم 400 مليون زوج من الصور والنصوص لنموذج CLIP، يمكن لـ TypeDance قياس التشابه بين الخط والصورة على مقياس يتراوح من

5.5 التكرار

على الرغم من أن التكرار موجود طوال العملية، فقد حددنا ثلاثة أنماط رئيسية للتكرار.

5.5.1 التجديد للتصميم الجديد. غالبًا ما تسمح الأدوات السابقة للمبدعين بحذف النتائج غير المرضية، لكن القليل منها يهدف إلى تحسين الأداء المتجدد ليتماشى مع نية المبدعين. لمعالجة هذا التحدي، تستخدم TypeDance كل من التعليقات البشرية الضمنية والصريحة لاستنتاج تفضيلات المستخدمين. مستلهمين من FABRIC [49]، نستفيد من ردود فعل المستخدمين تجاه النتائج المولدة كدليل على تفضيلاتهم. من خلال تحليل التعليقات الإيجابية من النتائج المحفوظة والتعليقات السلبية من الحذف، يقوم النموذج التوليدي في TypeDance بضبط الأوزان في طبقة الانتباه الذاتي بشكل ديناميكي. يسمح هذا الدمج التكراري للتعليقات البشرية بتحسين النموذج التوليدي مع مرور الوقت. بالإضافة إلى ذلك، توفر TypeDance للمستخدمين طرقًا أكثر وضوحًا لإجراء التعديلات، بما في ذلك موجه نصي ومنزلق يمكّن المستخدمين من التحكم في التوازن بين الخط والصورة.

5.5.2 تحسين في طيف الصورة النمطية. يوفر TypeDance نهجًا محسّنًا لتحسين تصميماتهم بشكل تكراري على طول طيف الصورة النمطية. بالإضافة إلى المقياس الكمي المحدد في مكون التقييم، يتيح TypeDance للمبدعين إجراء تعديلات دقيقة باستخدام نفس شريط التمرير. كما هو موضح في الشكل 5 (ج)، نقسم المسافة بين النقطة المحايدة ونمط الكتابة والصورة إلى 20 فترة متساوية، كل منها تمثل 0.05. تحافظ هذه التداخلات الصغيرة على الهيكل العام وتسمح بإجراء تعديلات تدريجية. من خلال سحب شريط التمرير، يمكن للمبدعين ضبط نقطة القيمة المرغوبة بين نمط الكتابة والصورة، مما يحقق جمالية متوازنة.

5.5.1 التجديد للتصميم الجديد. غالبًا ما تسمح الأدوات السابقة للمبدعين بحذف النتائج غير المرضية، لكن القليل منها يهدف إلى تحسين الأداء المتجدد ليتماشى مع نية المبدعين. لمعالجة هذا التحدي، تستخدم TypeDance كل من التعليقات البشرية الضمنية والصريحة لاستنتاج تفضيلات المستخدمين. مستلهمين من FABRIC [49]، نستفيد من ردود فعل المستخدمين تجاه النتائج المولدة كدليل على تفضيلاتهم. من خلال تحليل التعليقات الإيجابية من النتائج المحفوظة والتعليقات السلبية من الحذف، يقوم النموذج التوليدي في TypeDance بضبط الأوزان في طبقة الانتباه الذاتي بشكل ديناميكي. يسمح هذا الدمج التكراري للتعليقات البشرية بتحسين النموذج التوليدي مع مرور الوقت. بالإضافة إلى ذلك، توفر TypeDance للمستخدمين طرقًا أكثر وضوحًا لإجراء التعديلات، بما في ذلك موجه نصي ومنزلق يمكّن المستخدمين من التحكم في التوازن بين الخط والصورة.

5.5.2 تحسين في طيف الصورة النمطية. يوفر TypeDance نهجًا محسّنًا لتحسين تصميماتهم بشكل تكراري على طول طيف الصورة النمطية. بالإضافة إلى المقياس الكمي المحدد في مكون التقييم، يتيح TypeDance للمبدعين إجراء تعديلات دقيقة باستخدام نفس شريط التمرير. كما هو موضح في الشكل 5 (ج)، نقسم المسافة بين النقطة المحايدة ونمط الكتابة والصورة إلى 20 فترة متساوية، كل منها تمثل 0.05. تحافظ هذه التداخلات الصغيرة على الهيكل العام وتسمح بإجراء تعديلات تدريجية. من خلال سحب شريط التمرير، يمكن للمبدعين ضبط نقطة القيمة المرغوبة بين نمط الكتابة والصورة، مما يحقق جمالية متوازنة.

على وجه التحديد، لإعطاء الأولوية للصورة، نبدأ بالتصميم الحالي كالصورة الأولية وندخله في نموذج الانتشار مع ضبط القوة على القيمة المرغوبة. تدفع هذه العملية الصورة الناتجة نحو نهاية الصورة، مما يؤدي إلى تصميم أكثر ثراءً من الناحية الدلالية. وعلى العكس، لتسليط الضوء على نوع الخط، نستخدم خريطة البروز لنوع الخط في فضاء البكسل لتصفية المناطق ذات الصلة من الصورة. يتم إدخال هذه الصورة المعدلة في النموذج التوليدي لضمان انتقال سلس نحو نهاية نوع الخط.

5.5.3 قابلية التعديل للعناصر في التصميم النهائي. يتطلب الأمر ضبطًا أكثر دقة لإجراء تغييرات دقيقة على نتيجة شبه مرضية، مثل حذف عنصر من النتيجة المولدة. لتحقيق هذا المستوى من قابلية التعديل، نقوم بتحويل الصورة من الفضاء النقطي إلى الفضاء المتجهي. وبالتالي، يحصل المبدعون على القدرة على التلاعب بكل عنصر فردي في تصميمهم، مما يسمح لهم بإزالة العناصر، وتغيير حجمها، وتدويرها، وتغيير الألوان حسب الحاجة.

6 جولة في الواجهة

في TypeDance، يتم تنظيم المكونات التي تتبع سير العمل التصميمي في تخطيط متماسك على شكل حرف U على الواجهة، مع وجود اللوحة الرئيسية في المركز، كما هو موضح في الشكل 5. يهدف هذا التصميم إلى تسهيل التنقل السلس للمبدعين، مما يلغي الحاجة إلى التبديل المستمر بين المكونات المختلفة. اتبعًا لسير العمل الخاص بالمستخدم، نوضح كيف يخلق TypeDance تصاميم جذابة بصريًا. أليس هي مصممة جرافيك ترغب في إنشاء سلسلة من بطاقات البريد للمواسم الأربعة باستخدام رسومات طباعة دلالية خيالية. بدءًا من رحلتها الإبداعية، تبدأ أليس بالشخصية “春”، التي تعني “الربيع” باللغة الصينية.

6.1 مرحلة ما قبل التوليد

6.1.1 البحث عن أفكار التصميم. لجمع الإلهام التصميمي، تكتب أليس أولاً “أعطني بعض الأفكار عن الربيع” في قسم الأفكار، ثم تضغط على زر [العصف الذهني]. يقوم TypeDance بإنشاء قائمة من الأفكار مثل “طائر في العش” و”زهور متفتحة”. تمرر الماوس فوق هذه الأفكار، فتظهر الشروحات المقابلة لها.

6.1.2 إعداد مواد التصميم. أليس تكتب الحرف “春” في نوع الخط T وتختار نوع الخط “Mincho”. تستخدم السحب لتحديد الجزء السفلي من الحرف، الممثل كـ “日”، وتضغط على [

6.2 مرحلة التوليد

6.2.1 دمج نوع الخط والصور. تتصفح أليس عوامل التصميم المستخرجة في GENERATE++/+ وتختار خيارات [دلالي] و[لون]. تترك القوة على إعدادها الافتراضي 0.75 لمحاولتها الأولى. لإضافة المزيد من الصور المتعلقة بالربيع، تنظر مرة أخرى إلى IDEATION وتلاحظ “الطائر في العش”. ثم تقوم بإدخال العبارة “طائر على النافذة” في GENERATE وتقدم الجيل. بعد انتظار قصير لمدة 15 ثانية، يتم عرض النتائج في المعرض.

6.2.2 التجديد بالقوة المناسبة. بعد أن أدركت أن النتيجة الناتجة أقرب إلى نوع الخط، قامت بحذف النتائج غير المرغوب فيها وضبطت قوة عامل التصميم إلى 0.86 باستخدام شريط التمرير. في الجولة التالية، وجدت نتيجة مرغوبة ونقرت عليها. ثم تم عرض التصميم المختار في اللوحة المركزية.

6.3 مرحلة ما بعد التوليد

6.3.1 تقييم وتنقيح النتيجة الناتجة. لتقييم وضوحها، تتجه أليس إلى الجانب الأيمن من اللوحة وتضغط على زر [التقييم] في التقييم. الموقع الحالي للنتيجة يقع على الجانب التصويري من شريط التمرير بقيمة 0.55. ومع ذلك، بهدف استكشاف مواقع أكثر توافقًا مع جانب الخط، تسحب شريط التمرير إلى اليسار. بعد عدة تجارب، تحصل أليس على سلسلة من النتائج، كما هو موضح في الشكل 5.

الشكل 5. واجهة TypeDance، مع منشئ يشارك في تصميم طباعة دلالي. (أ) في مرحلة ما قبل التوليد، يقوم المنشئ بتوليد أفكار ويختار نوع الخط والصور كمواد تصميم. (ب) خلال التوليد، يقوم المنشئ بتحديد خيارات التوليد مع تقديم نص لتخصيص التصميم. (ج) في مرحلة ما بعد التوليد، يقوم المنشئ بتقييم وتنقيح التصميم في طيف الخط والصورة.

6.3.2 التحرير والتصدير. تعيد أليس العملية لدمج ضربة “J” مع الصور الزهرية. تقوم بتحويلها إلى تنسيق SVG وتعدل لون الزهور. أخيرًا، قامت أليس بتصدير التصميم من خلال النقر على زر [حفظ] في الزاوية العلوية اليمنى من الواجهة.

7 التقييم

لاختبار فعالية TypeDance، أجرينا مقارنة أساسية ودراسة مستخدم. كان هدفنا الأساسي هو تقييم أداء النتائج المولدة وسهولة استخدام TypeDance، واستكشاف كيف يمكن لكل مكون أن يعالج نقاط الألم في سير العمل التصميمي. بالإضافة إلى ذلك، قمنا بالتعمق في قيود الأداة وحددنا فرص التحسين.

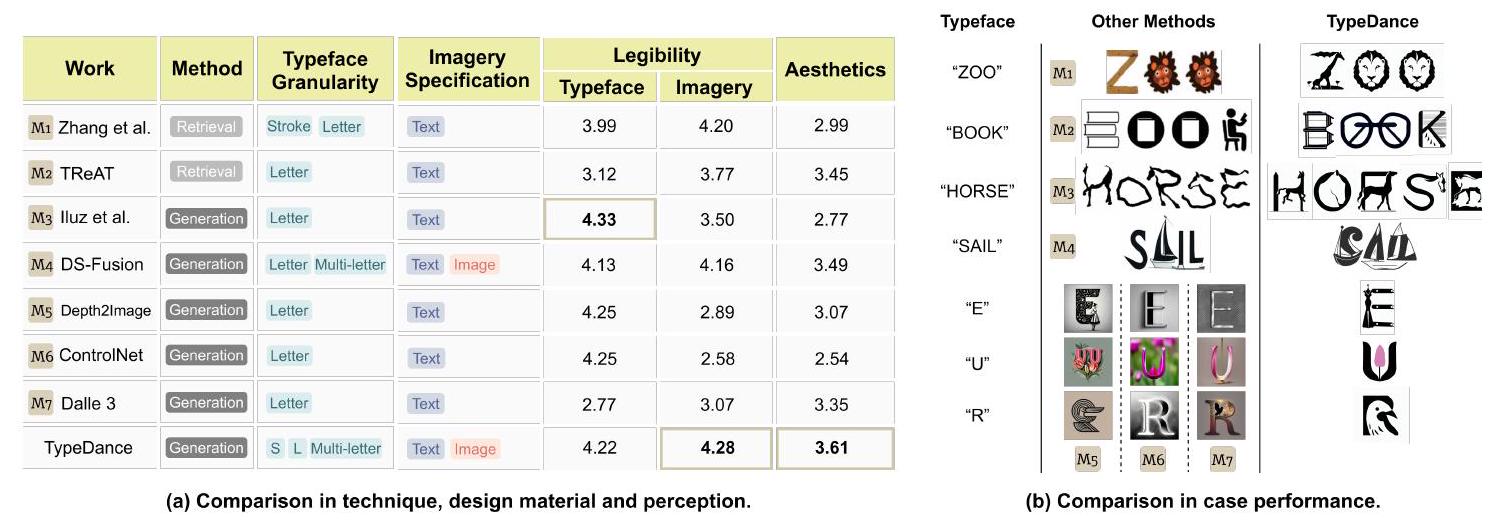

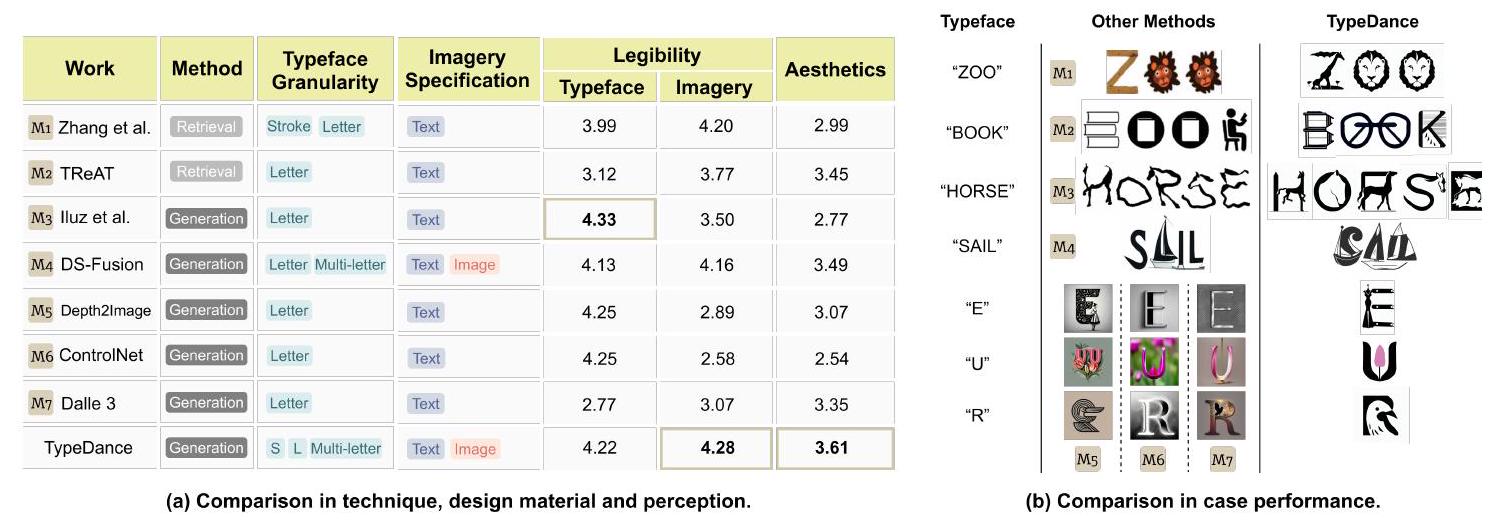

7.1 مقارنة الأساس

قمنا بإجراء مقارنة مع سبع طرق بديلة: Zhang et al. (M1)[61]، TReAT (M2)[48]، Word as Image (M3)[23]، DS-Fusion (M4)[47]، Depth2Image (M5)[34]، ControlNet (M6)[63]، Dalle 3 (M7)[5]. من أجل تقييم شامل، قمنا بتقييم هذه الطرق من منظورين تقني وإدراكي، كما هو موضح في الشكل 6. نظرًا لأن معظم الأعمال ليست مفتوحة المصدر، لم يكن من الممكن إجراء مقارنة شاملة باستخدام نفس الحالة. بدلاً من ذلك، قمنا بأخذ عينات عشوائية من ثلاث حالات من كل طريقة واستخدمنا TypeDance لإعادة إنشائها بنفس محتوى النص والصور، مع إجراء مقارنة واحدة لواحدة مع كل طريقة. الحالات الكاملة مدرجة في المواد التكميلية. شملت دراسة الإدراك استبيانًا عبر الإنترنت بمشاركة 50 فردًا. قمنا بخلط تسلسل الظهور لـ

الشكل 6. TypeDance مقابل الأسس: (أ) مقارنة في التقنية، مادة التصميم، والإدراك، و(ب) مقارنة في أداء الحالة.

جميع الشعارات ولم تقدم أي تلميحات حول نوع الخط أو الصور المستخدمة، وتم تسجيل الدرجات على مقياس ليكرت من 5 نقاط.

7.1.1 الفرق في التقنية. تعمل الطباعة الفنية وTReAT على نهج قائم على الاسترجاع، مما يحد من قدرتها على التعميم على الحالات التي تختلف بشكل كبير عن القوالب المجمعة. بالمقابل، تتبنى طرق أخرى نهجًا قائمًا على التوليد، مما يوفر بعض التخفيف لهذه القيود. ومع ذلك، فإن معظمها مقيد بالدمج على مستوى الحروف، بينما تتفوق TypeDance من خلال دعم الدمج على جميع مستويات نوع الخط. فيما يتعلق بالتفاعل لتحديد الصور، تعتمد الغالبية العظمى من الطرق على النص، إما من خلال استرجاع القوالب ذات الصلة من مجموعة بيانات أو توجيه النموذج التوليدي. ومن الجدير بالذكر أن DS-Fusion وTypeDance تبرزان حيث تدعمان استخدام الصور لتعيين تمثيلات بصرية محددة. ومع ذلك، من المهم الإشارة إلى أن DS-Fusion تتطلب من المستخدمين تقديم مجموعة صغيرة من الصور تتكون من حوالي 20 صورة لضبط النموذج، وهي عملية تستغرق حوالي 1.5 ساعة باستخدام جهاز كمبيوتر مكتبي مزود ببطاقة Nvidia GeForce RTX 3090.

7.1.2 دراسة الإدراك. استخدمنا مقياسين رئيسيين لتقييم أداء هذه الطرق: أحدهما يركز على وضوح الخط والصور، والآخر على الجمالية. كما هو موضح في الشكل 6، يتفوق TypeDance على الطرق الأخرى في كل من درجة الجمالية ووضوح الصور. يحقق Word as Image أعلى درجة في وضوح الخط، لكن صورته تعتبر صعبة التعرف عليها بالمقارنة. وبالمثل، تظهر العديد من الطرق هذا الخلل، حيث تتفوق في تمثيل واحد بينما تضعف في الآخر. على النقيض من ذلك، يحافظ TypeDance على أداء مستقر مع اعتراف جمالي جدير بالثناء.

7.1.1 الفرق في التقنية. تعمل الطباعة الفنية وTReAT على نهج قائم على الاسترجاع، مما يحد من قدرتها على التعميم على الحالات التي تختلف بشكل كبير عن القوالب المجمعة. بالمقابل، تتبنى طرق أخرى نهجًا قائمًا على التوليد، مما يوفر بعض التخفيف لهذه القيود. ومع ذلك، فإن معظمها مقيد بالدمج على مستوى الحروف، بينما تتفوق TypeDance من خلال دعم الدمج على جميع مستويات نوع الخط. فيما يتعلق بالتفاعل لتحديد الصور، تعتمد الغالبية العظمى من الطرق على النص، إما من خلال استرجاع القوالب ذات الصلة من مجموعة بيانات أو توجيه النموذج التوليدي. ومن الجدير بالذكر أن DS-Fusion وTypeDance تبرزان حيث تدعمان استخدام الصور لتعيين تمثيلات بصرية محددة. ومع ذلك، من المهم الإشارة إلى أن DS-Fusion تتطلب من المستخدمين تقديم مجموعة صغيرة من الصور تتكون من حوالي 20 صورة لضبط النموذج، وهي عملية تستغرق حوالي 1.5 ساعة باستخدام جهاز كمبيوتر مكتبي مزود ببطاقة Nvidia GeForce RTX 3090.

7.1.2 دراسة الإدراك. استخدمنا مقياسين رئيسيين لتقييم أداء هذه الطرق: أحدهما يركز على وضوح الخط والصور، والآخر على الجمالية. كما هو موضح في الشكل 6، يتفوق TypeDance على الطرق الأخرى في كل من درجة الجمالية ووضوح الصور. يحقق Word as Image أعلى درجة في وضوح الخط، لكن صورته تعتبر صعبة التعرف عليها بالمقارنة. وبالمثل، تظهر العديد من الطرق هذا الخلل، حيث تتفوق في تمثيل واحد بينما تضعف في الآخر. على النقيض من ذلك، يحافظ TypeDance على أداء مستقر مع اعتراف جمالي جدير بالثناء.

7.2 دراسة المستخدم

7.2.1 المشاركون. تم دعوة كل من المصممين والمستخدمين العامين (11 أنثى و7 ذكور، تتراوح أعمارهم بين 19-34) للحصول على تعليقات مختلفة. تسعة مشاركين (P1-P9) هم مستخدمون مبتدئون مهتمون بفن الطباعة الدلالية دون تدريب رسمي في التصميم. التسعة الآخرون هم مصممو جرافيك (E1-E9) لديهم تعليم تصميم احترافي مع أكثر من ثلاث سنوات من الخبرة في شعارات الطباعة الدلالية. جميع المشاركين قد جربوا أدوات الذكاء الاصطناعي مثل Midjourney من قبل. وقد وصلوا إلى TypeDance من خلال متصفحات الويب، مستخدمين مزيجًا من الأوضاع عبر الإنترنت وغير المتصلة. كعربون تقدير، تلقى كل مشارك

الشكل 7. المهمة الأولى للتقييم هي التقليد. في هذه المهمة، يُطلب من المستخدمين اختيار اثنين من ثلاثة مراجع وتقليد أسلوبهما. يتم عرض جزء من نتائج التصميم التي أنشأها المشاركون عبر TypeDance، مع تعليقات تشير إلى المواد التصميمية اللازمة، بما في ذلك نوع الخط والصور، وأنماط التصميم في تصاميمهم.

7.2.2 المهام والإجراءات. استلهمنا من عملية التصميم التي حددها أوكادا وآخرون [35]، والتي تحتوي على مرحلتين أساسيتين، وهما التقليد والإبداع، وقمنا بإعداد مهمتين وفقًا لذلك لتتناسب مع التحديات التصميمية الطبيعية والتقدمية. الإجراء الشامل موضح كما يلي:

-الإحاطة (20 دقيقة). قدمنا عدة أمثلة على الشعارات الطبوغرافية الدلالية من مجموعتنا المجمعة لتقديم الموضوع. لتسهيل الانتقال السريع للمشاركين إلى أدوارهم كمبدعين، استفسرنا عن تصميمهم المفضل وطلبنا منهم تخيل الخطوات المطلوبة لتحقيق مثل هذا التصميم. بعد ذلك، قدمنا TypeDance باستخدام المثال الموضح في الشكل 4. ثم تم تشجيع المشاركين على استكشاف TypeDance بشكل مستقل لمدة 5 دقائق لاكتساب مزيد من الألفة مع وظائفه.

-المهمة 1: التقليد (25 دقيقة). يُطلب من المشاركين اختيار اثنين من ثلاثة مراجع تصميم وتكرار أنماطها في تصاميمهم الخاصة. المرجع 1 يشجع المشاركين على دمج الصور التي تمثل شغفهم داخل نوع الخط “حب” على مستوى الحرف. المرجع 2 يسعى لدمج أكبر قدر ممكن من الصور، مع تصوير الفصول الأربعة داخل نوع الخط “春夏秋冬” على مستوى الضربات. المرجع 3 يركز على تشويه شكل الخطوط على مستوى الحروف المتعددة. تُظهر بعض نتائج تصميم المستخدمين في الشكل 7.

-المهمة 2: الإبداع (20 دقيقة). يُشجع المشاركون على استكشاف وإنشاء تصاميمهم الخاصة بحرية. بالنسبة لأولئك الذين ليس لديهم اتجاه إبداعي محدد، نقدم مواضيع مفتوحة مستمدة من مجموعتنا المجمعة (تعزيز الثقافة، العلامة التجارية للمنظمات، والهوية الشخصية) لإلهام الأفكار. يُشجع التفكير بصوت عالٍ خلال عملية الإبداع، وبعض نتائج تصميم المستخدمين موضحة في الشكل 8 والشكل 9.

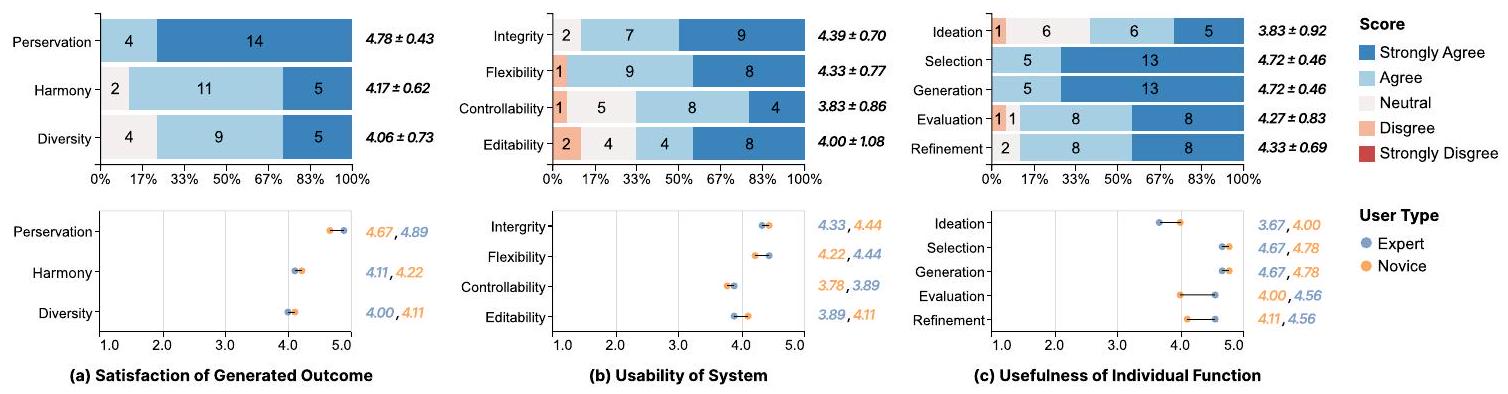

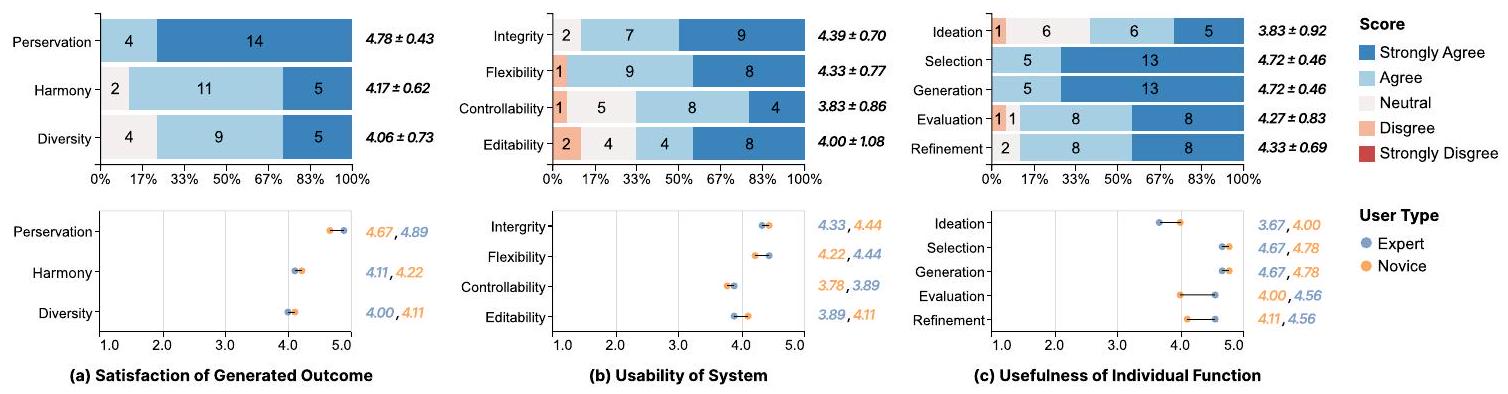

-المقابلة (20 دقيقة). في النهاية، أكمل كل مشارك استبيانًا بمقياس ليكرت من 5 نقاط. ركز الاستبيان على ثلاثة جوانب من TypeDance: 1) رضا الناتج الناتج، 2) قابلية استخدام نظام TypeDance، و 3) وظيفة كل مكون فردي داخل النظام. بالإضافة إلى ذلك، أجرينا مقابلة شبه منظمة مع كل مشارك لجمع ملاحظاتهم حول عملية التصميم.

-الإحاطة (20 دقيقة). قدمنا عدة أمثلة على الشعارات الطبوغرافية الدلالية من مجموعتنا المجمعة لتقديم الموضوع. لتسهيل الانتقال السريع للمشاركين إلى أدوارهم كمبدعين، استفسرنا عن تصميمهم المفضل وطلبنا منهم تخيل الخطوات المطلوبة لتحقيق مثل هذا التصميم. بعد ذلك، قدمنا TypeDance باستخدام المثال الموضح في الشكل 4. ثم تم تشجيع المشاركين على استكشاف TypeDance بشكل مستقل لمدة 5 دقائق لاكتساب مزيد من الألفة مع وظائفه.

-المهمة 1: التقليد (25 دقيقة). يُطلب من المشاركين اختيار اثنين من ثلاثة مراجع تصميم وتكرار أنماطها في تصاميمهم الخاصة. المرجع 1 يشجع المشاركين على دمج الصور التي تمثل شغفهم داخل نوع الخط “حب” على مستوى الحرف. المرجع 2 يسعى لدمج أكبر قدر ممكن من الصور، مع تصوير الفصول الأربعة داخل نوع الخط “春夏秋冬” على مستوى الضربات. المرجع 3 يركز على تشويه شكل الخطوط على مستوى الحروف المتعددة. تُظهر بعض نتائج تصميم المستخدمين في الشكل 7.

-المهمة 2: الإبداع (20 دقيقة). يُشجع المشاركون على استكشاف وإنشاء تصاميمهم الخاصة بحرية. بالنسبة لأولئك الذين ليس لديهم اتجاه إبداعي محدد، نقدم مواضيع مفتوحة مستمدة من مجموعتنا المجمعة (تعزيز الثقافة، العلامة التجارية للمنظمات، والهوية الشخصية) لإلهام الأفكار. يُشجع التفكير بصوت عالٍ خلال عملية الإبداع، وبعض نتائج تصميم المستخدمين موضحة في الشكل 8 والشكل 9.

-المقابلة (20 دقيقة). في النهاية، أكمل كل مشارك استبيانًا بمقياس ليكرت من 5 نقاط. ركز الاستبيان على ثلاثة جوانب من TypeDance: 1) رضا الناتج الناتج، 2) قابلية استخدام نظام TypeDance، و 3) وظيفة كل مكون فردي داخل النظام. بالإضافة إلى ذلك، أجرينا مقابلة شبه منظمة مع كل مشارك لجمع ملاحظاتهم حول عملية التصميم.

الشكل 8. المهمة التقييمية الثانية هي الإبداع. بالنسبة للمشاركين الذين ليس لديهم هدف إبداعي محدد، قدمنا مواضيع مفتوحة كإلهام. يتم عرض جزء من نتائج تصميم المواضيع المفتوحة التي أنشأها المشاركون عبر TypeDance، مع تعليقات تشير إلى المواد التصميمية اللازمة، بما في ذلك نوع الخط والصور، وأنماط التصميم في تصاميمهم.

7.3 تحليل النتائج

7.3.1 رضا الناتج الناتج. وجد جميع المشاركين أن الناتج الناتج يمزج بشكل فعال بين معلومات نوع الخط المختار والصور.

- الحفاظ. أعربت الغالبية العظمى من المشاركين (11/18) عن أن النتائج التي تم توليدها كانت “تفوق توقعاتهم” و”مبتكرة.” وجدوا أن TypeDance كان قادرًا على إنتاج نتائج معقولة تجمع بين نوع الخط والصورة بشكل فعال. كما ذكر P3، “لم أكن أرى في البداية أي علاقة بين البجعة والحرف ‘E’، لكن النتيجة أظهرت أنه يمكن دمجهما بطريقة visually pleasing (P3، الشكل 7).”

- التناغم. اتفق المشاركون (16/18) على أن النتائج الناتجة أظهرت تناغمًا جماليًا. نجح TypeDance في الحفاظ على وضوح نوع الخط بينما عزز الجاذبية البصرية من خلال دمج الصور التي “تتوافق مع هيكل النص (P1، P4، الشكل 7).”

- التنوع. وافق أكثر من نصف المشاركين على أن النتائج التي تم توليدها كانت متنوعة (14/18). بعض المشاركين (

) أكد على أهمية الحصول على تصاميم بديلة في الممارسة، وعلق قائلاً: “على الرغم من أنني حققت نتيجة مرضية، إلا أنني ما زلت أرغب في التجديد لرؤية نتائج أكثر إثارة (P2، الشكل 8؛ E7، الشكل 9).”

من حيث الحفظ، أظهر المستخدمون العامون حساسية أقل من المصممين في التعرف على نوع الخط والصور. على النقيض من ذلك، كان بإمكان المصممين إدراك المحتوى بسرعة وأظهروا ميلاً لتصدير التصاميم المحتملة إلى أدوات متقدمة لتعزيز الحفظ بشكل أكبر. على الرغم من اختلاف مستويات الخبرة في التصميم، أظهر كل من المستخدمين المبتدئين والمصممين درجات مشابهة من حيث التناغم وتنوع النتائج الناتجة. بالإضافة إلى التناغم الإدراكي، حدد المصممون المزيد من التأثيرات الفنية. كما علق E1، “لم أعتقد أبداً أن الذكاء الاصطناعي يمكن أن يفهم وينتج المساحة السلبية (الشكل 7).” في هذه الحالة، دمجت TypeDance الكلب في نوع الخط عن طريق ملء المساحة الفارغة

| مستخدم | عمر | جنس | مهنة | سيناريو | نية المستخدم | نوع الخط | صور | نتيجة | |||

| E5 | 34 | أنثى | مصممة |

|

شعار أنيق مع خاتم زفاف، والعروس والعريس يندمجان مع اسم الشركة بلِس. | بلِس |  |

|

|||

| E6 | 28 | ذكر | مصمم | منظمة بيئية | شعار مع الأرض وورقة لتسليط الضوء على التركيز البيئي. | إيكو فيجن |  |

|

|||

| P9 | 19 | ذكر | طالب | نادي الهيب هوب | أريد أن أرتبط بالراقص مع حرفي ‘D’ لجعل شعارنا أكثر تأثيراً. | DtD |  |

|

|||

| E7 | 26 | أنثى | مصممة | شركة ناشئة تكنولوجية | دمج عناصر تتعلق بالفن والتكنولوجيا في اسم الشركة. | آرت آل |  |

|

|||

| E8 | 23 | أنثى | مصممة | مدونة القطط | أوريو هو قطة لديها العديد من المعجبين على وسائل التواصل الاجتماعي، وأحتاج إلى تصميم صورة ملف شخصي جديدة لها بناءً على صورتها واسمها. | أوريو |  |

|

|||

| E9 | 29 | ذكر | مصمم | استوديو موسيقي | شعار مع نوتات موسيقية وجيتار يندمج مع اسم الاستوديو. | بيات |  |

|

الشكل 9. في مهمة الإبداع، استخدم بعض المشاركين TypeDance لتلبية احتياجاتهم الإبداعية المحددة. بالنسبة لهؤلاء المشاركين، تم تسجيل معلوماتهم الشخصية، السيناريو، ونية الإبداع. بالإضافة إلى ذلك، تم عرض المواد التصميمية اللازمة، بما في ذلك نوع الخط والصور، جنبًا إلى جنب مع نتائج التصميم في الجدول.

في الرسالة

7.3.2 قابلية استخدام النظام. أظهرت دراسة المستخدم أن معظم المشاركين (

7.3.2 قابلية استخدام النظام. أظهرت دراسة المستخدم أن معظم المشاركين (

- سلامة. وافق معظم المشاركين

بشدة على أن سير العمل الكامل قد تم تجسيده داخل TypeDance. وأبرز أحد المشاركين، “لا أحتاج إلى التبديل بين منصات مختلفة لإنهاء تصميم (E2، الشكل 8).” - مرونة. وافق نصف المشاركين (

) بشدة على المرونة التي توفرها TypeDance لتخصيص تصاميمهم. جرب معظم المشاركين ( ) أكثر من نوعين من درجات نوع الخط في تصاميمهم. أشار E2 إلى، “يمكنني بسهولة اختيار ضربة واحدة تتداخل مع ضربات أخرى في نوع الخط.” - قابلية التحكم. وافق أكثر من نصف المشاركين (

) على أن TypeDance توفر مستوى عالٍ من القابلية للتحكم. وجدوا أن النتائج الناتجة كانت قادرة على “عكس الصور المختارة” و”الالتزام بالشكل المختار”. - قابلية التعديل. تم الاتفاق بشدة على قابلية تعديل TypeDance من قبل نصف المشاركين (

). أعرب العديد من المشاركين ( ) عن رغبتهم في أداة توليد لا تنتج التصاميم مرة واحدة فقط ولكن أيضًا توفر القدرة على إجراء التعديلات وتصحيح النتائج.

اعترف جميع المشاركين على نطاق واسع بسلامة سير العمل في TypeDance، مع وجهات نظر مختلفة من المصممين والمستخدمين العامين. قيم المصممون ذلك لدمجه الوظائف الأساسية التي تتطلب عادةً التبديل بين منصات مختلفة في سير العمل التقليدي، بينما أشاد المستخدمون العامون بـ TypeDance لأنها تسمح لهم بمتابعة المكونات في الواجهة بشكل متسلسل لإنهاء تصميم. يتطلب الشعار تخصيصًا عاليًا بخصائصه الخاصة

الشكل 10. تقييمات المستخدمين لـ TypeDance، بما في ذلك (أ) رضا عن النتيجة الناتجة، (ب) قابلية استخدام النظام، و (ج) فائدة الوظيفة الفردية. تظهر الرسوم البيانية الثلاثة المكدسة أعلاه تقييم المستخدم العام لمؤشرات مختلفة لـ TypeDance، بينما توضح الرسوم البيانية الثلاثة أدناه التفضيلات المميزة بين الخبراء والمبتدئين، مع عرض قيم التقييم المتوسطة لهاتين المجموعتين من المستخدمين.

لكشف الهوية. تضيف الخيار لاختيار الصور من الصور الشخصية لمسة شخصية، متجاوزة الموارد المتاحة في مجتمع مشترك. أكد كل من المصممين والمبتدئين على القدرة على التحكم واستلهام الإلهام من العالم الحقيقي مع تمثيل بصري محدد، لون، وشكل. هذه الميزة مهمة بشكل خاص في بعض السيناريوهات، مثل “تصميم شعار مدينة.”

الفجوة بين المرونة وقابلية التعديل توضح التوقعات المختلفة من المصممين والمستخدمين العامين. أظهر المستخدمون العامون اهتمامًا أقل في تجربة درجات مختلفة من نوع الخط، مستخدمين بشكل أساسي دمج مستوى الحرف. من ناحية أخرى، أشاد المصممون بشدة بهذه الوظيفة لأنها تسمح لهم بتقسيم أجزاء مختلفة من نوع الخط أو حتى الدمج عبر درجات مختلفة. بعد الحصول على النتائج الناتجة، يعبر المستخدمون العامون عن رضاهم عن تغيير الألوان أو حذف العناصر (P4 & P6، الشكل 8). يجد المصممون متعة في وظيفة التنقيح، كما يشير E5 “إنها تحاكي عملية التصميم الحقيقية حيث يتم تبسيط الصور تدريجيًا أو إضافة تفاصيل إلى نوع الخط (E5، الشكل 9).” كما أعربوا عن رغبتهم في المزيد من وظائف التحرير المتقدمة، مثل منحنيات بيزير، لضبط الأشكال.

7.3.3 فائدة الوظائف الفردية. قدم المشاركون أيضًا تقييمات لكل مكون داخل نظام TypeDance. حصلت مكونات الاختيار والتوليد على اتفاق بالإجماع من جميع المشاركين، مع درجات عالية وقابلة للمقارنة. كان للتناسق بين اختيار نوع الخط والصور والنظر في عوامل التصميم، مثل إعداد المواد التصميمية، تأثير مباشر على درجات مكونات الاختيار والتوليد. قال E3، “يوفر لي الكثير من الوقت لاختيار نوع الخط المطلوب وضبط منحنيات البيزير لإنشاء أشكال تشبه أشياء معينة، مثل كلب.” كما قدروا النطاق المتنوع من النتائج التي يقدمها النظام، والتي وجدوا أنها حاسمة لعملية التصميم (

الفجوة بين المرونة وقابلية التعديل توضح التوقعات المختلفة من المصممين والمستخدمين العامين. أظهر المستخدمون العامون اهتمامًا أقل في تجربة درجات مختلفة من نوع الخط، مستخدمين بشكل أساسي دمج مستوى الحرف. من ناحية أخرى، أشاد المصممون بشدة بهذه الوظيفة لأنها تسمح لهم بتقسيم أجزاء مختلفة من نوع الخط أو حتى الدمج عبر درجات مختلفة. بعد الحصول على النتائج الناتجة، يعبر المستخدمون العامون عن رضاهم عن تغيير الألوان أو حذف العناصر (P4 & P6، الشكل 8). يجد المصممون متعة في وظيفة التنقيح، كما يشير E5 “إنها تحاكي عملية التصميم الحقيقية حيث يتم تبسيط الصور تدريجيًا أو إضافة تفاصيل إلى نوع الخط (E5، الشكل 9).” كما أعربوا عن رغبتهم في المزيد من وظائف التحرير المتقدمة، مثل منحنيات بيزير، لضبط الأشكال.

7.3.3 فائدة الوظائف الفردية. قدم المشاركون أيضًا تقييمات لكل مكون داخل نظام TypeDance. حصلت مكونات الاختيار والتوليد على اتفاق بالإجماع من جميع المشاركين، مع درجات عالية وقابلة للمقارنة. كان للتناسق بين اختيار نوع الخط والصور والنظر في عوامل التصميم، مثل إعداد المواد التصميمية، تأثير مباشر على درجات مكونات الاختيار والتوليد. قال E3، “يوفر لي الكثير من الوقت لاختيار نوع الخط المطلوب وضبط منحنيات البيزير لإنشاء أشكال تشبه أشياء معينة، مثل كلب.” كما قدروا النطاق المتنوع من النتائج التي يقدمها النظام، والتي وجدوا أنها حاسمة لعملية التصميم (

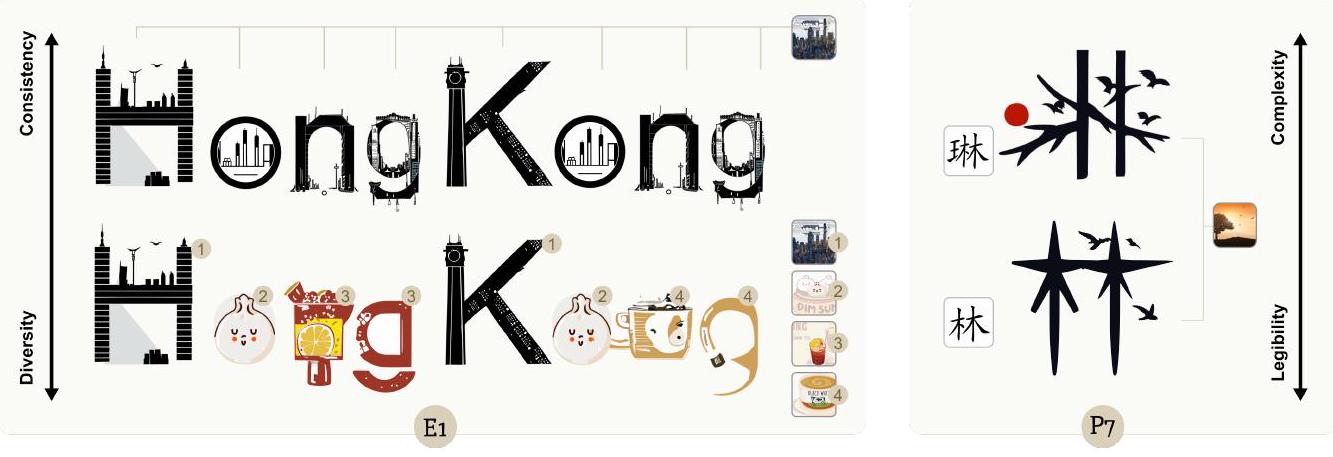

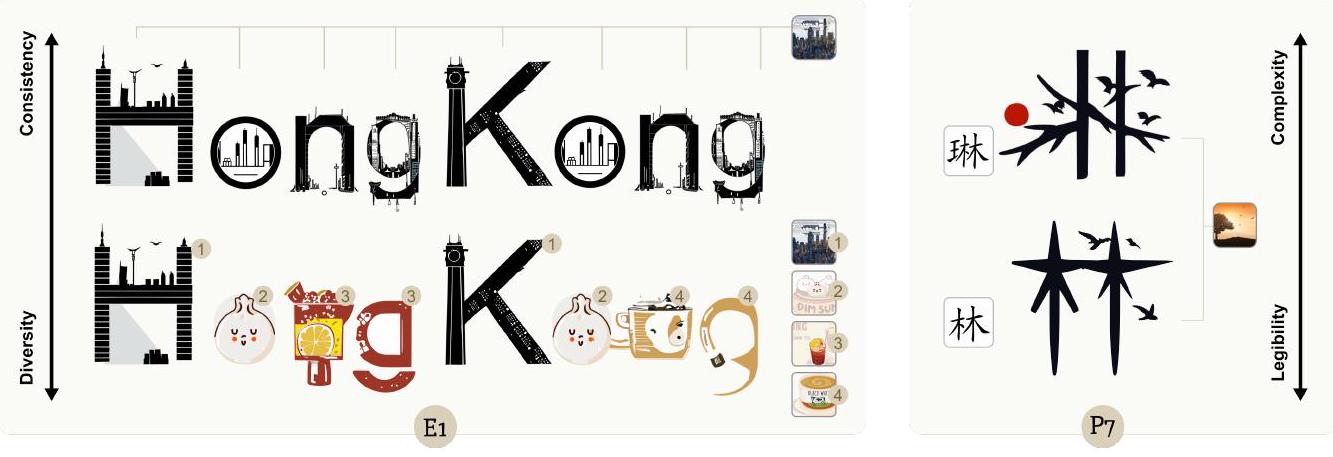

الشكل 11. التبادلات التي تم الكشف عنها في حالات المشاركين. الشكل على اليسار يظهر التبادل بين تنوع الصور وتناسق الأسلوب، حيث سيؤدي العدد المتزايد من الصور إلى اختلافات في الأسلوب. الشكل على الجانب الأيمن يظهر التبادل بين تعقيد نوع الخط وقابلية القراءة، حيث قد يؤدي زيادة تعقيد نوع الخط إلى انخفاض محتمل في قابلية قراءة النتائج.

7.4 قيود

استجابةً للمشكلات التي واجهها المستخدمون أثناء استخدام TypeDance، حددنا القيود الرئيسية للنظام الحالي من ثلاثة أبعاد.

7.4.1 التجربة والخطأ في اختيار نوع الخط والصور. على الرغم من أن TypeDance الحالي يسمح للمبدعين بالاختيار والدمج بشكل مرن، مما يسهل التوليد السريع، تشير ملاحظات المشاركين إلى أن التجربة والخطأ مع التوافق غير المتجانس بين نوع الخط والصور قد تطيل عملية الإبداع. على سبيل المثال، حقق E9 التصميم النهائي بعد ثلاث محاولات، حيث جرب درجات مختلفة من نوع الخط، بما في ذلك “Bea”، ”

7.4.2 التوازن بين تنوع الصور وتناسق نمط النتيجة. توضح الشكل 11 هذه القيود، حيث يؤدي استخدام نفس الصورة لـ “هونغ كونغ” إلى إنتاج نتيجة متناسقة من الناحية الأسلوبية، بينما يؤدي استخدام صور مختلفة إلى عدم تناسق ملحوظ. علق E1، “تبدو هذه العناصر جيدة بشكل فردي، ولكن عند دمجها، تظهر غير متناسقة.” ينشأ هذا التناقض من نقل الصور والأسلوب من مراجع الصور إلى النتيجة الناتجة، مما يؤدي إلى أنماط متنوعة عند استخدام مراجع متعددة. بينما يعد إضافة موجه نصي حلاً جزئيًا لتخفيف هذه المشكلة، إلا أنه يفتقر إلى التحكم الدقيق. إن دمج صور متعددة ضمن نوع خط واحد هو تنسيق شائع ومهم لشعارات الطباعة الدلالية. وبالتالي، فإن تحقيق التحكم الدقيق في تنوع الصور وتناسق نمط النتيجة يبقى مجالًا مهمًا لمزيد من التحقيق.

7.4.3 التوازن بين تعقيد نوع الخط وقابلية قراءة النتيجة. عندما يرتفع تعقيد نوع الخط المستخدم في الإبداع (على سبيل المثال، زيادة الخطوط أو الحروف)، قد تنخفض قابلية قراءة النتيجة الناتجة بشكل متناسب. كما يظهر الجانب الأيمن من الشكل 11، عند استخدام نفس الصورة خلال عملية الإبداع، فإن توضيح “林” سهل القراءة، بينما يظهر تقديم “琳” بشكل أكثر تجريدًا. يشير ذلك إلى أن القدرة الحالية على التوليد في TypeDance لا يمكن أن تؤدي بشكل جيد في الحالات التي تحتوي على نوع خط معقد، مثل كلمة صينية كاملة، أو عدة حروف. السبب الرئيسي هو أن نوع الخط المعقد يوفر هيكلًا غنيًا في البداية للنموذج التوليدي ليقوم بتصميمه. لمواجهة

هذه المشكلة، يجب على TypeDance إيجاد حل قابل للتطبيق لتعزيز التحكم في عملية التصميم أثناء التوليد، لتحقيق توازن بين تعقيد نوع الخط وقابلية القراءة.

7.4.1 التجربة والخطأ في اختيار نوع الخط والصور. على الرغم من أن TypeDance الحالي يسمح للمبدعين بالاختيار والدمج بشكل مرن، مما يسهل التوليد السريع، تشير ملاحظات المشاركين إلى أن التجربة والخطأ مع التوافق غير المتجانس بين نوع الخط والصور قد تطيل عملية الإبداع. على سبيل المثال، حقق E9 التصميم النهائي بعد ثلاث محاولات، حيث جرب درجات مختلفة من نوع الخط، بما في ذلك “Bea”، ”

7.4.2 التوازن بين تنوع الصور وتناسق نمط النتيجة. توضح الشكل 11 هذه القيود، حيث يؤدي استخدام نفس الصورة لـ “هونغ كونغ” إلى إنتاج نتيجة متناسقة من الناحية الأسلوبية، بينما يؤدي استخدام صور مختلفة إلى عدم تناسق ملحوظ. علق E1، “تبدو هذه العناصر جيدة بشكل فردي، ولكن عند دمجها، تظهر غير متناسقة.” ينشأ هذا التناقض من نقل الصور والأسلوب من مراجع الصور إلى النتيجة الناتجة، مما يؤدي إلى أنماط متنوعة عند استخدام مراجع متعددة. بينما يعد إضافة موجه نصي حلاً جزئيًا لتخفيف هذه المشكلة، إلا أنه يفتقر إلى التحكم الدقيق. إن دمج صور متعددة ضمن نوع خط واحد هو تنسيق شائع ومهم لشعارات الطباعة الدلالية. وبالتالي، فإن تحقيق التحكم الدقيق في تنوع الصور وتناسق نمط النتيجة يبقى مجالًا مهمًا لمزيد من التحقيق.

7.4.3 التوازن بين تعقيد نوع الخط وقابلية قراءة النتيجة. عندما يرتفع تعقيد نوع الخط المستخدم في الإبداع (على سبيل المثال، زيادة الخطوط أو الحروف)، قد تنخفض قابلية قراءة النتيجة الناتجة بشكل متناسب. كما يظهر الجانب الأيمن من الشكل 11، عند استخدام نفس الصورة خلال عملية الإبداع، فإن توضيح “林” سهل القراءة، بينما يظهر تقديم “琳” بشكل أكثر تجريدًا. يشير ذلك إلى أن القدرة الحالية على التوليد في TypeDance لا يمكن أن تؤدي بشكل جيد في الحالات التي تحتوي على نوع خط معقد، مثل كلمة صينية كاملة، أو عدة حروف. السبب الرئيسي هو أن نوع الخط المعقد يوفر هيكلًا غنيًا في البداية للنموذج التوليدي ليقوم بتصميمه. لمواجهة

هذه المشكلة، يجب على TypeDance إيجاد حل قابل للتطبيق لتعزيز التحكم في عملية التصميم أثناء التوليد، لتحقيق توازن بين تعقيد نوع الخط وقابلية القراءة.

8 المناقشة

8.1 التصميم الشخصي: التعاون المدرك للنية مع الذكاء الاصطناعي

أدى ظهور نماذج اللغة الكبيرة إلى زيادة كبيرة في تصميم الإبداع المدفوع بالنص [6،51،58]، مما يمكّن المبدعين من التعاون مع الذكاء الاصطناعي باستخدام السرد بلغة طبيعية. بينما يوفر الإبداع المدفوع بالنص وسيلة بديهية للتلاعب بالنموذج في الخلفية دون الخوض في معلمات معقدة يدويًا، فإن التعبير عن نية المستخدم بشكل مختصر من خلال الموجهات النصية يمثل تحديًا. يصبح صياغة الموجه أمرًا صعبًا بشكل خاص عند وصف تصميم بصري متخيل، نظرًا للعديد من التفاصيل مثل التخطيط، واللون، والشكل التي تتجاوز التمثيل النصي. يعترف PromptPaint [10] بهذا التحدي ويقترب منه من خلال مزج مجموعة من الموجهات النصية لالتقاط المفاهيم الغامضة، مثل “لون أقل حيوية قليلاً.” ومع ذلك، لا يزال مقيدًا بتقديم مجموعة محددة مسبقًا من الموجهات ويفشل أساسًا في حل مشكلة تمثيل المفاهيم البصرية الملموسة من خلال الموجهات.

لضمان توافق نية المبدع بسلاسة مع التعاون مع الذكاء الاصطناعي، من الضروري عكس الممارسات التصميمية الحقيقية مع مواد تصميم متاحة. تشمل المواد التصميمية الشائعة المستخدمة من قبل المبدعين المعارض القابلة للاستكشاف [60]، والرسومات [11]، وحتى الصور التي تلتقط إدراكنا للعالم [31، 62]. تشمل هذه المواد التصميمية البصرية كل من النوايا الصريحة، مثل الدلالات البارزة، والعوامل الجمالية الضمنية. في تصميم الشعار، هناك تركيز ملحوظ على الهوية، باستخدام الصور بشكل متكرر لنقل النوايا. لا يمكن تجاهل هذا الجانب في التعاون مع الذكاء الاصطناعي، مما يتطلب قدرة للذكاء الاصطناعي على فهم الدلالات البصرية. يكشف ذلك أنه لا يوجد مادة متفوقة عالميًا لتجسيد نية المبدع؛ بل يعتمد على مهمة التصميم. يتطلب ذلك تعاونًا هجينًا ومتعدد الوسائط يمكن أن يتعمم بمرونة على مجموعة واسعة من المتطلبات.

8.2 دمج المعرفة التصميمية في أدوات دعم الإبداع

يتطلب غرس نمط التصميم القابل للتعميم في الأدوات معالجة التحديات التقنية والتفاعلية المتعلقة بكيفية توجيه البشر للنموذج. غالبًا ما لا تُبنى نماذج الذكاء الاصطناعي لمهمة التصميم الخاصة، مما يطرح تحديات في التعميم على الأنماط المعقدة. على سبيل المثال، تناولت أبحاث كبيرة [47،61] تقنيات الدمج لدرجات معينة من نوع الخط. ومع ذلك، فإن أدوات دعم الإبداع موجهة نحو المستخدم، مع متطلبات تصميم أكثر تعقيدًا، مما يتطلب تقنيات متقدمة لاستيعاب جميع مستويات درجات نوع الخط. بدلاً من إعادة تدريب نموذج، استكشفت أبحاث كبيرة تغيير أو إضافة التفاعل مع النماذج لدمج المعرفة التصميمية، مثل تحديد معلمات التصميم المدعومة من الجمهور [27] والتدخل من خلال التمثيلات الوسيطة [57].

تظهر الجوانب التقنية والتفاعلية لدمج المعرفة التصميمية فكرة “موازنة الأتمتة والتحكم”، والتي غالبًا ما يتم الإشارة إليها من قبل إرشادات التصميم الحالية بين البشر والذكاء الاصطناعي [1،2،19]. إن دمج المعرفة التصميمية التي يتحكم فيها المبدعون يعالج جزئيًا مشكلة حقوق الطبع والنشر للذكاء الاصطناعي. واجهت النماذج التوليدية الحالية انتقادات بسبب أخذ عينات من أمثلة من مجموعة التدريب. في TypeDance، يساهم المستخدمون بمواد تصميم من خلال الصور، مما يسمح بأساس شخصي بدلاً من النسخ المباشر من مجموعة بيانات محددة مسبقًا. لا تعزز هذه الطريقة الإبداع فحسب، بل تساعد أيضًا في إنشاء شعور أقوى بالملكية للمبدعين. إن الأتمتة الكاملة باستخدام نموذج واحد لتحقيق نتيجة شاملة تتجاهل قيمة المستخدم. تكمن جاذبية أداة دعم الإبداع، بدلاً من الاعتماد فقط على نموذج، في تمكين المبدعين من المشاركة في المراحل الحاسمة. تشمل هذه المشاركة تخصيص مواد التصميم، واختيار المعرفة التصميمية التي سيتم نقلها إلى عملية التوليد، وتنقيح النتيجة النهائية.

8.3 سير العمل التصميمي الموجه للمستخدم المختلط

بهدف تطوير أداة ذات “عتبة منخفضة” للمبتدئين لتوجيه التوليد و”سقف مرتفع” للخبراء لتحقيق تأثيرات أكثر تقدمًا، يدمج TypeDance سير عمل تصميم قابل للمحاكاة. تم تصميم أدوات دعم الإبداع بطبيعتها لتوفير تجربة تأليف شاملة، تعالج كل من التركيزات الشائعة والفريدة من مستخدمين متنوعين [57، 58، 65]. كما هو موضح في الشكل 10، يشارك الخبراء والمصممون تفضيلات مشابهة ومتميزة. يمكن اعتبار الوظائف ذات التفضيلات المشتركة، مثل الاختيار والتوليد، مركزية في سير العمل وتستحق تحقيقًا أعمق. من الجدير بالذكر أن هناك وظائف ذات تفضيلات متباينة بناءً على الخبرة. يميل الخبراء إلى إعطاء الأولوية للتقييم والتنقيح، بينما قد يرى المبتدئون هذه كخيارات اختيارية. ومع ذلك، مع خلفية تصميم أقل، يجد المبتدئون أن الإبداع مفيد أكثر من الخبراء. تعمل الوظائف ذات التفضيلات المختلفة كـ “جدار واسع”، تستوعب متطلبات المستخدم الاختيارية. بينما ليست إلزامية مثل الوظائف المركزية، فإن إغفالها يضر بالنزاهة العامة لسير العمل.

9 الخاتمة

تستخلص هذه الدراسة معرفة التصميم من أمثلة العالم الحقيقي، وتلخص أنماط التصميم القابلة للتعميم وسير العمل التصميمي القابل للمحاكاة، وتستكشف إنشاء شعارات طباعة دلالية من خلال دمج الخطوط والصور مع الحفاظ على القابلية للقراءة. نقدم TypeDance، أداة تأليف تعتمد على نموذج توليدي يدعم سير عمل تصميم مخصص يشمل التفكير، والاختيار، والتوليد، والتقييم، والتكرار. مع TypeDance، يمكن للمبدعين اختيار الخطوط بشكل مرن على مستويات مختلفة من الدقة ودمجها مع صور محددة باستخدام عوامل تصميم قابلة للجمع. كما يسمح TypeDance للمستخدمين بضبط النتائج المولدة على طيف الخط-الصورة ويقدم تحريرًا لاحقًا للعناصر الفردية. تؤكد تعليقات المستخدمين العامين والخبراء فعالية TypeDance وتوفر رؤى قيمة لفرص المستقبل. نحن متحمسون لتعزيز وظائف TypeDance لسير عمل شامل واستكشاف تقنيات وتفاعلات جديدة لتعزيز الإبداع البشري.

REFERENCES

[1] Saleema Amershi, Dan Weld, Mihaela Vorvoreanu, Adam Fourney, Besmira Nushi, Penny Collisson, Jina Suh, Shamsi Iqbal, Paul N Bennett, Kori Inkpen, et al. 2019. Guidelines for human-AI interaction. In Proceedings of the 2019 chi conference on human factors in computing systems. 1-13.

[2] Apple. 2021. Human Interface Guidelines. https://developer.apple.com/design/human-interface-guidelines/, Last accessed on 2023-12-13.

[3] Gregory Ashworth and Mihalis Kavaratzis. 2009. Beyond the logo: Brand management for cities. Journal of Brand Management 16 (2009), 520-531.

[4] Daniel Berio, Frederic Fol Leymarie, Paul Asente, and Jose Echevarria. 2022. Strokestyles: Stroke-based segmentation and stylization of fonts. ACM Transactions on Graphics 41, 3, Article 28 (2022), 21 pages.

[5] James Betker, Gabriel Goh, Li Jing, Tim Brooks, Jianfeng Wang, Linjie Li, Long Ouyang, Juntang Zhuang, Joyce Lee, Yufei Guo, et al. 2023. Improving image generation with better captions. Computer Science. https://cdn. openai. com/papers/dall-e-3. pdf (2023).

[6] Yining Cao, Jane L E, Zhutian Chen, and Haijun Xia. 2023. DataParticles: Block-based and language-oriented authoring of animated unit visualizations. In Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems. 1-15.

[7] Terry L Childers and Jeffrey Jass. 2002. All dressed up with something to say: Effects of typeface semantic associations on brand perceptions and consumer memory. Journal of Consumer Psychology 12, 2 (2002), 93-106.

[8] Lydia B Chilton, Ecenaz Jen Ozmen, Sam H Ross, and Vivian Liu. 2021. VisiFit: Structuring iterative improvement for novice designers. In Proceedings of the CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery, 1-14.

[9] Lydia B Chilton, Savvas Petridis, and Maneesh Agrawala. 2019. VisiBlends: A flexible workflow for visual blends. In Proceedings of the CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery, 1-14.

[10] John Joon Young Chung and Eytan Adar. 2023. PromptPaint: Steering Text-to-Image Generation Through Paint Medium-like Interactions. In Proceedings of the 36th Annual ACM Symposium on User Interface Software and Technology. 1-17.

[11] John Joon Young Chung, Wooseok Kim, Kang Min Yoo, Hwaran Lee, Eytan Adar, and Minsuk Chang. 2022. TaleBrush: Sketching stories with generative pretrained language models. In Proceedings of the 2022 CHI Conference on Human Factors in Computing Systems. 1-19.

[12] Weiwei Cui, Xiaoyu Zhang, Yun Wang, He Huang, Bei Chen, Lei Fang, Haidong Zhang, Jian-Guan Lou, and Dongmei Zhang. 2019. Text-to-viz: Automatic generation of infographics from proportion-related natural language statements. IEEE Transactions on Visualization and Computer Graphics 26, 1 (2019), 906-916.

[13] João M Cunha, Nuno Lourenço, Pedro Martins, and Penousal Machado. 2020. Visual blending for concept representation: A case study on emoji generation. New Generation Computing 38, 4 (2020), 739-771.

[14] Laura Devendorf and Kimiko Ryokai. 2013. AnyType: provoking reflection and exploration with aesthetic interaction. In Proceedings of the SIGCHI Conference on Human Factors in Computing Systems. 1041-1050.

[15] Ryan Dew, Asim Ansari, and Olivier Toubia. 2022. Letting logos speak: Leveraging multiview representation learning for data-driven branding and logo design. Marketing Science 41, 2 (2022), 401-425.

[16] Evelyn Fix and Joseph Lawson Hodges. 1989. Discriminatory analysis. Nonparametric discrimination: Consistency properties. International Statistical Review/Revue Internationale de Statistique 57, 3 (1989), 238-247.

[17] Rinon Gal, Yuval Alaluf, Yuval Atzmon, Or Patashnik, Amit H. Bermano, Gal Chechik, and Daniel Cohen-Or. 2022. An Image is Worth One Word: Personalizing Text-to-Image Generation using Textual Inversion. arXiv:2208.01618

[18] Rinon Gal, Or Patashnik, Haggai Maron, Amit H Bermano, Gal Chechik, and Daniel Cohen-Or. 2022. StyleGAN-NADA: CLIP-guided domain adaptation of image generators. ACM Transactions on Graphics 41, 4, Article 141 (2022), 13 pages.

[19] Google. 2019. People + AI Guidebook. https://pair.withgoogle.com/, Last accessed on 2023-12-13.

[20] Pamela W Henderson and Joseph A Cote. 1998. Guidelines for selecting or modifying logos. Fournal of Marketing 62, 2 (1998), 14-30.

[21] Yon Ade Lose Hermanto. 2023. Semantic Interpretation in Experimental Typography Creation. KnE Social Sciences 8, 15 (2023), 252-257.

[22] Kai-Wen Hsiao, Yong-Liang Yang, Yung-Chih Chiu, Min-Chun Hu, Chih-Yuan Yao, and Hung-Kuo Chu. 2023. Img2Logo: Generating Golden Ratio Logos from Images. In Computer Graphics Forum, Vol. 42. Wiley Online Library, 37-49.

[23] Shir Iluz, Yael Vinker, Amir Hertz, Daniel Berio, Daniel Cohen-Or, and Ariel Shamir. 2023. Word-As-Image for Semantic Typography. ACM Transactions on Graphics 42, 4, Article 151 (2023), 11 pages.

[24] Youwen Kang, Zhida Sun, Sitong Wang, Zeyu Huang, Ziming Wu, and Xiaojuan Ma. 2021. MetaMap: Supporting visual metaphor ideation through multi-dimensional example-based exploration. In Proceedings of the CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery, Article 427, 15 pages.

[25] Alexander Kirillov, Eric Mintun, Nikhila Ravi, Hanzi Mao, Chloe Rolland, Laura Gustafson, Tete Xiao, Spencer Whitehead, Alexander C. Berg, Wan-Yen Lo, Piotr Dollár, and Ross Girshick. 2023. Segment Anything. arXiv:2304.02643

[26] Janin Koch, Andrés Lucero, Lena Hegemann, and Antti Oulasvirta. 2019. May AI? Design ideation with cooperative contextual bandits. In Proceedings of the CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery, 1-12.

[27] Yuki Koyama, Daisuke Sakamoto, and Takeo Igarashi. 2014. Crowd-powered parameter analysis for visual design exploration. In Proceedings of the 27th annual ACM symposium on User interface software and technology. 65-74.

[28] Jieun Lee, Eunju Ko, and Carol M Megehee. 2015. Social benefits of brand logos in presentation of self in cross and same gender influence contexts. Journal of Business Research 68, 6 (2015), 1341-1349.

[29] Junnan Li, Dongxu Li, Caiming Xiong, and Steven Hoi. 2022. Blip: Bootstrapping language-image pre-training for unified vision-language understanding and generation. In Proceedings of the International Conference on Machine Learning, Vol. 162. PMLR, 12888-12900.

[30] Yi-Na Li, Kang Zhang, and Dong-Jin Li. 2017. Rule-based automatic generation of logo designs. Leonardo 50, 2 (2017), 177-181.

[31] Giorgia Lupi and Stefanie Posavec. 2018. Observe, collect, draw!: A visual journal: Discover the patterns in your everyday life. Princeton Architectural Press.

[32] O Mataev and H Mataev. 2006. Olga’s gallery. giuseppe Arcimboldo.

[33] Mark Meyer, Alan Barr, Haeyoung Lee, and Mathieu Desbrun. 2002. Generalized barycentric coordinates on irregular polygons. Journal of Graphics Tools 1 (2002), 13-22.

[34] Chong Mou, Xintao Wang, Liangbin Xie, Jian Zhang, Zhongang Qi, Ying Shan, and Xiaohu Qie. 2023. T2i-adapter: Learning adapters to dig out more controllable ability for text-to-image diffusion models. arXiv:2302.08453

[35] Takeshi Okada and Kentaro Ishibashi. 2017. Imitation, inspiration, and creation: Cognitive process of creative drawing by copying others’ artworks. Cognitive Science 41, 7 (2017), 1804-1837.

[36] Long Ouyang, Jeffrey Wu, Xu Jiang, Diogo Almeida, Carroll Wainwright, Pamela Mishkin, Chong Zhang, Sandhini Agarwal, Katarina Slama, Alex Ray, et al. 2022. Training language models to follow instructions with human feedback. Advances in Neural Information Processing Systems 35 (2022), 27730-27744.

[37] Helen Petrie, Fraser Hamilton, and Neil King. 2004. Tension, what tension? Website accessibility and visual design. In Proceedings of the International Cross-Disciplinary Workshop on Web Accessibility, Vol. 63. Association for Computing Machinery, 13-18.

[38] Huy Quoc Phan, Hongbo Fu, and Antoni B Chan. 2015. Flexyfont: Learning transferring rules for flexible typeface synthesis. In Computer Graphics Forum, Vol. 34. Wiley Online Library, 245-256.

[39] Alec Radford, Jong Wook Kim, Chris Hallacy, Aditya Ramesh, Gabriel Goh, Sandhini Agarwal, Girish Sastry, Amanda Askell, Pamela Mishkin, Jack Clark, et al. 2021. Learning transferable visual models from natural language supervision. In Proceedings of the International Conference on Machine Learning, Vol. 139. PMLR, 8748-8763.

[40] Aditya Ramesh, Prafulla Dhariwal, Alex Nichol, Casey Chu, and Mark Chen. 2022. Hierarchical text-conditional image generation with clip latents. arXiv:2204.06125

[41] Aditya Ramesh, Mikhail Pavlov, Gabriel Goh, Scott Gray, Chelsea Voss, Alec Radford, Mark Chen, and Ilya Sutskever. 2021. Zero-shot text-to-image generation. In Proceedings of the International Conference on Machine Learning, Vol. 139. PMLR, 8821-8831.

[42] Robin Rombach, Andreas Blattmann, Dominik Lorenz, Patrick Esser, and Björn Ommer. 2022. High-Resolution Image Synthesis With Latent Diffusion Models. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. IEEE, 10684-10695.

[43] Subhadip Roy and Rekha Attri. 2022. Physimorphic vs. Typographic logos in destination marketing: Integrating destination familiarity and consumer characteristics. Tourism Management 92 (2022), 104544.

[44] Patsorn Sangkloy, Wittawat Jitkrittum, Diyi Yang, and James Hays. 2022. A sketch is worth a thousand words: Image retrieval with text and sketch. In Proceedings of the European Conference on Computer Vision. Springer, 251-267.

[45] Yang Shi, Pei Liu, Siji Chen, Mengdi Sun, and Nan Cao. 2022. Supporting expressive and faithful pictorial visualization design with visual style transfer. IEEE Transactions on Visualization and Computer Graphics 29, 1 (2022), 236-246.

[46] Ben Shneiderman. 2007. Creativity support tools: accelerating discovery and innovation. Commun. ACM 50, 12 (2007), 20-32.

[47] Maham Tanveer, Yizhi Wang, Ali Mahdavi-Amiri, and Hao Zhang. 2023. DS-Fusion: Artistic Typography via Discriminated and Stylized Diffusion. In Proceedings of the International Conference on Computer Vision. IEEE.

[48] Purva Tendulkar, Kalpesh Krishna, Ramprasaath R Selvaraju, and Devi Parikh. 2019. Trick or TReAT: Thematic reinforcement for artistic typography. arXiv:1903.07820

[49] Dimitri von Rütte, Elisabetta Fedele, Jonathan Thomm, and Lukas Wolf. 2023. FABRIC: Personalizing Diffusion Models with Iterative Feedback. arXiv:2307.10159

[50] Yizhi Wang, Yue Gao, and Zhouhui Lian. 2020. Attribute2font: Creating fonts you want from attributes. ACM Transactions on Graphics 39, 4, Article 69 (2020), 15 pages.

[51] Yun Wang, Zhitao Hou, Leixian Shen, Tongshuang Wu, Jiaqi Wang, He Huang, Haidong Zhang, and Dongmei Zhang. 2022. Towards natural language-based visualization authoring. IEEE Transactions on Visualization and Computer Graphics 29, 1 (2022), 1222-1232.

[52] Yizhi Wang, Guo Pu, Wenhan Luo, Yexin Wang, Pengfei Xiong, Hongwen Kang, and Zhouhui Lian. 2022. Aesthetic text logo synthesis via content-aware layout inferring. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. IEEE, 2436-2445.

[53] Jason Wei, Xuezhi Wang, Dale Schuurmans, Maarten Bosma, Fei Xia, Ed Chi, Quoc V Le, Denny Zhou, et al. 2022. Chain-of-thought prompting elicits reasoning in large language models. Advances in Neural Information Processing Systems 35 (2022), 24824-24837.

[54] Shishi Xiao, Suizi Huang, Yue Lin, Yilin Ye, and Wei Zeng. 2023. Let the Chart Spark: Embedding Semantic Context into Chart with Text-to-Image Generative Model. arXiv:2304.14630

[55] Jie Xu and Craig S Kaplan. 2007. Calligraphic packing. In Proceedings of Graphics Interface. Association for Computing Machinery, 43-50.

[56] Xiaotong Xu, Rosaleen Xiong, Boyang Wang, David Min, and Steven P Dow. 2021. Ideaterelate: An examples gallery that helps creators explore ideas in relation to their own. Proceedings of the ACM on Human-Computer Interaction 5, CSCW2, Article 352(2021), 18 pages.

[57] Chuan Yan, John Joon Young Chung, Yoon Kiheon, Yotam Gingold, Eytan Adar, and Sungsoo Ray Hong. 2022. FlatMagic: Improving flat colorization through AI-driven design for digital comic professionals. In Proceedings of the 2022 CHI Conference on Human Factors in Computing Systems. 1-17.

[58] Zihan Yan, Chunxu Yang, Qihao Liang, and Xiang’Anthony’ Chen. 2023. XCreation: A Graph-based Crossmodal Generative Creativity Support Tool. In Proceedings of the 36th Annual ACM Symposium on User Interface Software and Technology. 1-15.

[59] Shuai Yang, Jiaying Liu, Zhouhui Lian, and Zongming Guo. 2017. Awesome typography: Statistics-based text effects transfer. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. IEEE, 7464-7473.

[60] Enhao Zhang and Nikola Banovic. 2021. Method for exploring generative adversarial networks (gans) via automatically generated image galleries. In Proceedings of the 2021 CHI Conference on Human Factors in Computing Systems. 1-15.

[61] Junsong Zhang, Yu Wang, Weiyi Xiao, and Zhenshan Luo. 2017. Synthesizing ornamental typefaces. In Computer Graphics Forum, Vol. 36. Wiley Online Library, 64-75.

[62] Jiayi Eris Zhang, Nicole Sultanum, Anastasia Bezerianos, and Fanny Chevalier. 2020. DataQuilt: Extracting visual elements from images to craft pictorial visualizations. In Proceedings of the CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery, 1-13.

[63] Lvmin Zhang and Maneesh Agrawala. 2023. Adding conditional control to text-to-image diffusion models. arXiv:2302.05543

[64] Nanxuan Zhao, Nam Wook Kim, Laura Mariah Herman, Hanspeter Pfister, Rynson WH Lau, Jose Echevarria, and Zoya Bylinskii. 2020. Iconate: Automatic compound icon generation and ideation. In Proceedings of the CHI Conference on Human Factors in Computing Systems. Association for Computing Machinery, 1-13.

[65] Tongyu Zhou, Connie Liu, Joshua Kong Yang, and Jeff Huang. 2023. filtered. ink: Creating Dynamic Illustrations with SVG Filters. In Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems. 1-15.

[66] Changqing Zou, Junjie Cao, Warunika Ranaweera, Ibraheem Alhashim, Ping Tan, Alla Sheffer, and Hao Zhang. 2016. Legible compact calligrams. ACM Transactions on Graphics 35, 4, Article 122 (2016), 12 pages.

[2] Apple. 2021. Human Interface Guidelines. https://developer.apple.com/design/human-interface-guidelines/, Last accessed on 2023-12-13.

[3] Gregory Ashworth and Mihalis Kavaratzis. 2009. Beyond the logo: Brand management for cities. Journal of Brand Management 16 (2009), 520-531.

[4] Daniel Berio, Frederic Fol Leymarie, Paul Asente, and Jose Echevarria. 2022. Strokestyles: Stroke-based segmentation and stylization of fonts. ACM Transactions on Graphics 41, 3, Article 28 (2022), 21 pages.

[5] James Betker, Gabriel Goh, Li Jing, Tim Brooks, Jianfeng Wang, Linjie Li, Long Ouyang, Juntang Zhuang, Joyce Lee, Yufei Guo, et al. 2023. Improving image generation with better captions. Computer Science. https://cdn. openai. com/papers/dall-e-3. pdf (2023).